Un grupo creciente de abogados está descubriendo, navegando y luchando contra los sistemas automatizados que niegan la vivienda, el trabajo y los servicios básicos.

por Karen Hao

Miriam tenía solo 21 años cuando conoció a Nick. Ella era fotógrafa, recién salida de la universidad, sirviendo mesas. Él era 16 años mayor que ella y propietario de un negocio local que había trabajado en finanzas. Era encantador y carismático; la llevaba a citas elegantes y pagó por todo. Ella rápidamente cayó en su órbita.

Comenzó con una tarjeta de crédito. En ese momento, era el único que tenía. Nick lo maximizaría con $ 5,000 en compras comerciales y lo pagaría de inmediato al día siguiente. Miriam, quien me pidió que no usara sus nombres reales por temor a interferir con sus procedimientos de divorcio en curso, descubrió que esto estaba mejorando su puntaje crediticio. Habiendo crecido con un padre soltero en un hogar de bajos ingresos, confiaba en los conocimientos de Nick sobre los suyos. Él rápidamente alentó la dinámica, diciéndole que ella no entendía las finanzas. Abrió más tarjetas de crédito para él con su nombre.

El problema comenzó tres años después. Nick le pidió que dejara su trabajo para ayudar con su negocio. Ella hizo. Él le dijo que fuera a la escuela de posgrado y que no se preocupara por agravar su deuda estudiantil existente. Ella hizo. Prometió hacerse cargo de todo y ella le creyó. Poco después, dejó de liquidar los saldos de sus tarjetas de crédito. Su puntuación comenzó a desmoronarse.

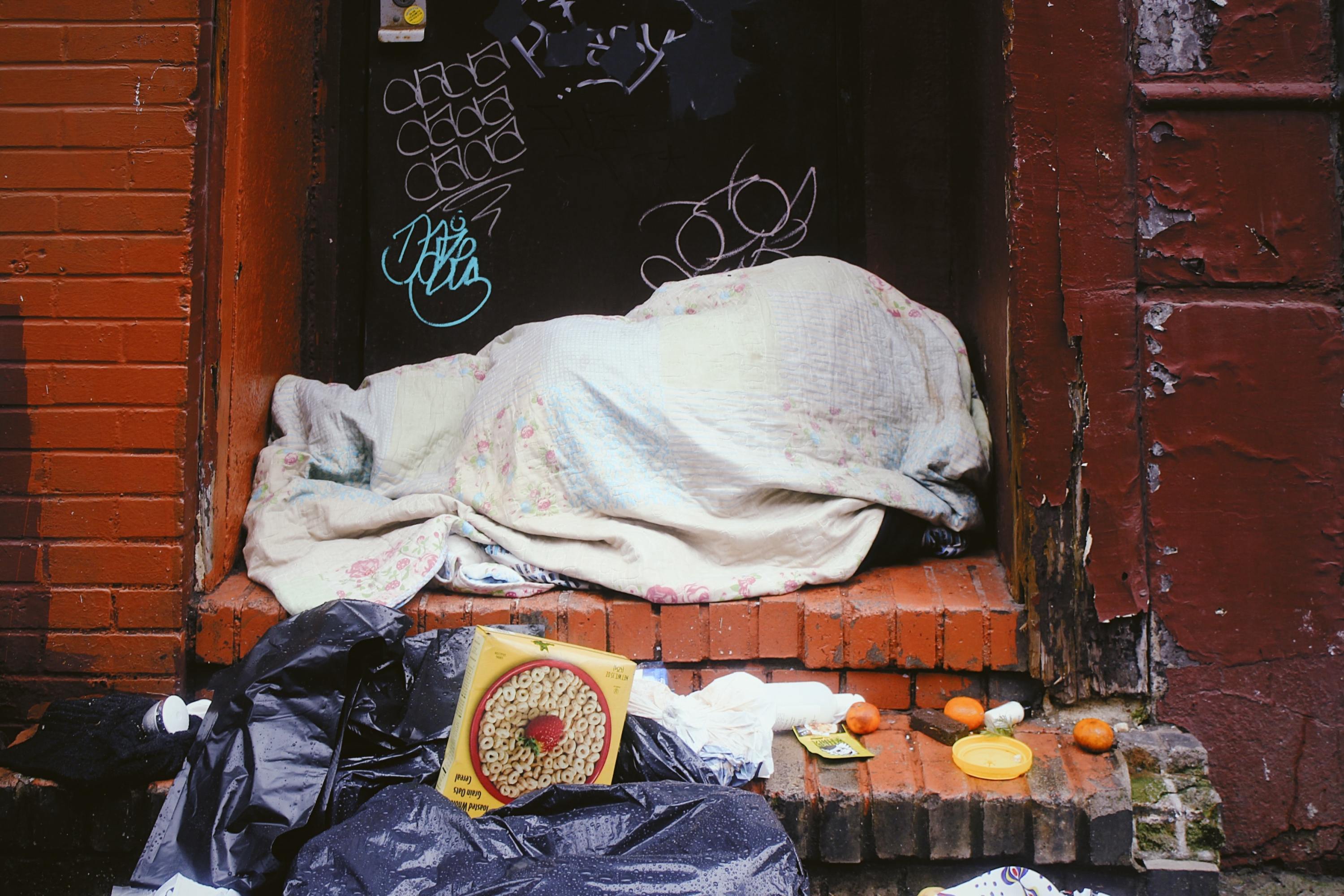

Aun así, Miriam se quedó con él. Se casaron. Tuvieron tres hijos. Entonces, un día, el FBI fue a su casa y lo arrestó. En la corte federal, el juez lo condenó por casi $ 250,000 por fraude electrónico. Miriam descubrió el alcance total de las decenas de miles de dólares en deuda que él había acumulado en su nombre. “El día que él fue a la cárcel, yo tenía 250 dólares en efectivo, una casa en ejecución hipotecaria, un automóvil en proceso de recuperación, tres hijos”, dice. “Pasé en un mes de tener una niñera y vivir en una casa bonita y todo a una pobreza realmente abyecta”.

Miriam es una sobreviviente de lo que se conoce como “deuda forzada”, una forma de abuso generalmente perpetrada por una pareja íntima o un miembro de la familia. Si bien el abuso económico es un problema de larga data, la banca digital ha facilitado la apertura de cuentas y la obtención de préstamos a nombre de la víctima, dice Carla Sanchez-Adams, abogada de Texas RioGrande Legal Aid. En la era de los algoritmos automatizados de calificación crediticia, las repercusiones también pueden ser mucho más devastadoras.

Los puntajes crediticios se han utilizado durante décadas para evaluar la solvencia crediticia del consumidor, pero su alcance es mucho mayor ahora que funcionan con algoritmos: no solo consideran muchos más datos, tanto en volumen como en tipo, sino que afectan cada vez más la posibilidad de comprar un coche, alquilar un apartamento o conseguir un trabajo de tiempo completo. Su amplia influencia significa que si su puntaje se arruina, puede ser casi imposible recuperarlo. Peor aún, los algoritmos son propiedad de empresas privadas que no divulgan cómo toman sus decisiones. Las víctimas pueden ser enviadas en una espiral descendente que a veces termina en la falta de vivienda o en el regreso a su abusador.

Los algoritmos de calificación crediticia no son los únicos que afectan el bienestar económico de las personas y el acceso a los servicios básicos. Los algoritmos ahora deciden qué niños ingresan en hogares de acogida, qué pacientes reciben atención médica y qué familias tienen acceso a una vivienda estable. Aquellos de nosotros con medios podemos pasar la vida sin darnos cuenta de nada de esto. Pero para las personas de bajos ingresos, el rápido crecimiento y la adopción de sistemas automatizados de toma de decisiones ha creado una red oculta de trampas entrelazadas.

Afortunadamente, un grupo creciente de abogados civiles está comenzando a organizarse en torno a este tema. Tomando prestado un libro de jugadas del rechazo del mundo de la defensa criminal contra los algoritmos de evaluación de riesgos, buscan educarse sobre estos sistemas, construir una comunidad y desarrollar estrategias de litigio. “Básicamente, todos los abogados civiles están comenzando a lidiar con estas cosas, porque todos nuestros clientes están siendo afectados de una forma u otra por estos sistemas”, dice Michele Gilman, profesora de derecho clínico en la Universidad de Baltimore. “Necesitamos despertarnos, entrenarnos. Si queremos ser realmente buenos abogados holísticos, debemos ser conscientes de eso “.

“¿Voy a contraexaminar un algoritmo?”

Gilman ha ejercido la abogacía en Baltimore durante 20 años. En su trabajo como abogada civil y abogada de pobreza, sus casos siempre se han reducido a lo mismo: representar a personas que han perdido el acceso a necesidades básicas, como vivienda, alimentación, educación, trabajo o atención médica. A veces eso significa enfrentarse a una agencia gubernamental. Otras veces es con una agencia de informes crediticios o con el propietario. Cada vez más, la lucha por la elegibilidad de un cliente implica ahora algún tipo de algoritmo.

“Esto está sucediendo en todos los ámbitos para nuestros clientes”, dice. “Están enredados en tantos algoritmos diferentes que los excluyen de los servicios básicos. Y es posible que los clientes no se den cuenta de eso, porque muchos de estos sistemas son invisibles “.

No recuerda exactamente cuándo se dio cuenta de que algunos algoritmos estaban tomando algunas decisiones de elegibilidad. Pero cuando esa transición comenzó a ocurrir, rara vez fue obvia. Una vez, ella representaba a un cliente anciano y discapacitado que inexplicablemente había sido desconectado de su asistencia médica domiciliaria financiada por Medicaid. “No pudimos averiguar por qué”, recuerda Gilman. “Ella se estaba poniendo más enferma y, normalmente, si te enfermas más, tienes más horas, no menos”.

El testigo que representaba al estado no reveló que el gobierno acababa de adoptar un nuevo algoritmo hasta que estuvieron de pie en la sala del tribunal en medio de una audiencia. El testigo, una enfermera, no pudo explicar nada al respecto. “Por supuesto que no, lo compraron listo para usar”, dice Gilman. “Ella es enfermera, no científica informática. No pudo responder qué factores intervienen. ¿Cómo se pondera? ¿Cuáles son los resultados que busca? Así que ahí estoy con mi abogado estudiante, que está en mi clínica conmigo, y es como, ‘Oh, ¿voy a contrainterrogar un algoritmo?’ “

Para Kevin De Liban, abogado de Legal Aid of Arkansas, el cambio fue igualmente insidioso. En 2014, su estado también instituyó un nuevo sistema para distribuir asistencia domiciliaria financiada por Medicaid, eliminando a una gran cantidad de personas que anteriormente eran elegibles. En ese momento, él y sus colegas no pudieron identificar la raíz del problema. Solo sabían que algo era diferente. “Podríamos reconocer que hubo un cambio en los sistemas de evaluación de un cuestionario en papel de 20 preguntas a un cuestionario electrónico de 283 preguntas”, dice.

Dos años después, cuando un error en el algoritmo volvió a ponerlo bajo escrutinio legal, De Liban finalmente llegó al fondo del problema. Se dio cuenta de que las enfermeras les decían a los pacientes: “Bueno, la computadora lo hizo, no soy yo”. “Eso es lo que nos dio la pista”, dice. “Si hubiera sabido lo que sabía en 2016, probablemente hubiera hecho un mejor trabajo de defensa en 2014”, agrega.

“Una persona recorre tantos sistemas en el día a día”

Desde entonces, Gilman se ha vuelto mucho más inteligente. Desde su posición ventajosa que representa a clientes con una variedad de problemas, ha observado el surgimiento y la colisión de dos redes algorítmicas. El primero consiste en algoritmos de informes crediticios, como los que atraparon a Miriam, que afectan el acceso a bienes y servicios privados como automóviles, hogares y empleo. El segundo abarca algoritmos adoptados por agencias gubernamentales, que afectan el acceso a beneficios públicos como atención médica, desempleo y servicios de manutención infantil.

Por el lado de los informes crediticios, el crecimiento de los algoritmos se ha visto impulsado por la proliferación de datos, que es más fácil que nunca recopilar y compartir. Los informes de crédito no son nuevos, pero en estos días su huella es mucho más amplia. Las agencias de informes del consumidor, incluidas las agencias de informes crediticios, las empresas de detección de inquilinos o los servicios de verificación de cheques, acumulan esta información de una amplia gama de fuentes: registros públicos, redes sociales, navegación web, actividad bancaria, uso de aplicaciones y más. Luego, los algoritmos asignan a las personas puntuaciones de “dignidad”, que figuran en gran medida en las verificaciones de antecedentes realizadas por prestamistas, empleadores, propietarios e incluso escuelas.

Las agencias gubernamentales, por otro lado, se ven impulsadas a adoptar algoritmos cuando quieren modernizar sus sistemas. El impulso para adoptar aplicaciones basadas en la web y herramientas digitales comenzó a principios de la década de 2000 y ha continuado con un movimiento hacia más sistemas automatizados e IA basados en datos. Hay buenas razones para buscar estos cambios. Durante la pandemia, muchos sistemas de prestaciones por desempleo tuvieron dificultades para manejar el enorme volumen de nuevas solicitudes, lo que provocó importantes retrasos. La modernización de estos sistemas heredados promete resultados más rápidos y confiables.

Pero el proceso de adquisición de software rara vez es transparente y, por lo tanto, carece de responsabilidad. Las agencias públicas a menudo compran herramientas de toma de decisiones automatizadas directamente de proveedores privados. El resultado es que cuando los sistemas fallan, las personas afectadas, y sus abogados, quedan en la oscuridad. “No lo anuncian en ninguna parte”, dice Julia Simon-Mishel, abogada de Philadelphia Legal Assistance. “A menudo no está escrito en ningún tipo de guías o manuales de políticas. Estamos en desventaja “.

La falta de investigación pública también hace que los sistemas sean más propensos a errores. Una de las fallas más atroces ocurrió en Michigan en 2013. Después de un gran esfuerzo para automatizar el sistema de beneficios de desempleo del estado, el algoritmo marcó incorrectamente a más de 34,000 personas por fraude . “Causó una pérdida masiva de beneficios”, dice Simon-Mishel. “Hubo quiebras; lamentablemente hubo suicidios. Fue un desastre total “.

Las personas de bajos ingresos son las más afectadas por el cambio hacia los algoritmos. Son las personas más vulnerables a las dificultades económicas temporales que se codifican en informes de los consumidores y las que necesitan y buscan beneficios públicos. A lo largo de los años, Gilman ha visto cada vez más casos en los que los clientes corren el riesgo de entrar en un círculo vicioso. “Una persona recorre tantos sistemas en el día a día”, dice ella. Quiero decir, todos lo hacemos. Pero las consecuencias son mucho más duras para los pobres y las minorías ”.

Ella menciona un caso actual en su clínica como ejemplo. Un miembro de la familia perdió el trabajo debido a la pandemia y se le negaron los beneficios de desempleo debido a una falla del sistema automatizado. Luego, la familia se retrasó en el pago del alquiler, lo que llevó al propietario a demandarlos por desalojo. Si bien el desalojo no será legal debido a la moratoria de los CDC, la demanda aún se registrará en registros públicos. Esos registros podrían luego incorporarse a algoritmos de selección de inquilinos, lo que podría dificultar que la familia encuentre una vivienda estable en el futuro. El hecho de que no paguen el alquiler y los servicios públicos también podría afectar su puntaje crediticio, lo que una vez más tiene repercusiones. “Si están tratando de establecer un servicio de telefonía celular o pedir un préstamo o comprar un automóvil o solicitar un trabajo, simplemente tiene estos efectos dominó en cascada”, dice Gilman.

“Cada caso se convertirá en un caso de algoritmo”

En septiembre, Gilman, quien actualmente es miembro de la facultad en el instituto de investigación Data and Society, publicó un informe que documenta todos los algoritmos que pueden encontrar los abogados de la pobreza. Se llama Poverty Lawgorithms y está destinado a ser una guía para sus colegas en el campo. Dividido en áreas de práctica específicas como derecho del consumidor, derecho de familia, vivienda y beneficios públicos, explica cómo tratar los problemas planteados por algoritmos y otras tecnologías basadas en datos dentro del alcance de las leyes existentes.

Si a un cliente se le niega un apartamento debido a una mala calificación crediticia, por ejemplo, el informe recomienda que un abogado verifique primero si los datos que se ingresan en el sistema de calificación son precisos. Según la Ley de informes de crédito justos, las agencias de informes deben garantizar la validez de su información, pero esto no siempre sucede. Disputar cualquier reclamo defectuoso podría ayudar a restaurar el crédito del cliente y, por lo tanto, el acceso a la vivienda. El informe reconoce, sin embargo, que las leyes existentes solo pueden llegar hasta cierto punto. Aún quedan vacíos regulatorios por llenar, dice Gilman.

Gilman espera que el informe sea una llamada de atención. Muchos de sus colegas todavía no se dan cuenta de que esto está sucediendo y no pueden hacer las preguntas correctas para descubrir los algoritmos. Aquellos que son conscientes del problema están dispersos por los EE. UU., Aprendiendo, navegando y combatiendo estos sistemas de forma aislada. Ella ve una oportunidad para conectarlos y crear una comunidad más amplia de personas que pueden ayudarse entre sí. “Todos necesitamos más capacitación, más conocimiento, no solo en la ley, sino en estos sistemas”, dice. “En última instancia, es como si todos los casos se fueran a convertir en un caso de algoritmo”.

Miles de inquilinos están siendo expulsados de sus hogares por teléfono y videollamada.

A la larga, busca inspiración en el mundo del derecho penal. Los abogados penales han estado “por delante de la curva”, dice ella, al organizarse como una comunidad y rechazar los algoritmos de evaluación de riesgos que determinan las sentencias. Quiere que los abogados civiles hagan lo mismo: crear un movimiento para llevar más escrutinio público y regulación a la red oculta de algoritmos que enfrentan sus clientes. “En algunos casos, probablemente debería cerrarse porque no hay forma de hacerlo equitativo”, dice.

En cuanto a Miriam, después de la condena de Nick, se marchó para siempre. Se mudó con sus tres hijos a un nuevo estado y se conectó con una organización sin fines de lucro que apoya a sobrevivientes de deudas forzadas y violencia doméstica. A través de ellos, tomó una serie de clases que le enseñaron cómo administrar sus finanzas. La organización la ayudó a descartar muchas de sus deudas forzadas y a aprender más sobre los algoritmos de crédito. Cuando fue a comprar un automóvil, su puntaje crediticio apenas superaba el mínimo con su padre como codeudor. Desde entonces, los pagos constantes de su automóvil y su deuda estudiantil han ido recuperando su puntaje crediticio.

Miriam todavía tiene que estar alerta. Nick tiene su número de seguro social y aún no están divorciados. Ella se preocupa constantemente de que pueda abrir más cuentas, pedir más préstamos a su nombre. Durante un tiempo, revisó su informe crediticio todos los días en busca de actividad fraudulenta. Pero en estos días, ella también tiene algo que esperar. Su padre, de unos 60 años, quiere jubilarse y mudarse. Ahora los dos están enfocados en prepararse para comprar una casa. “Estoy bastante emocionado por eso. Mi objetivo es para fin de año llegar a 700 ”, dice sobre su puntaje,“ y entonces definitivamente estaré lista para comprar una casa”.

“Nunca he vivido en una casa que haya tenido, nunca”, agrega. “Él y yo estamos trabajando juntos para ahorrar para un hogar para siempre”.

Historia relacionada

Iniciar sesión para ser expulsado: dentro de la crisis de desalojo virtual de Estados Unidos