OpenAI ha ampliado GPT-3 con dos nuevos modelos que combinan NLP con reconocimiento de imágenes para que su IA comprenda mejor los conceptos cotidianos.

por Will Douglas

Con GPT-3 , OpenAI demostró que un solo modelo de aprendizaje profundo se puede entrenar para usar el lenguaje de varias formas simplemente lanzando grandes cantidades de texto. Luego mostró que al intercambiar texto por píxeles, se podría usar el mismo enfoque para entrenar una IA para completar imágenes a medio terminar. GPT-3 imita cómo los humanos usan las palabras. La imagen GPT-3 predice lo que vemos.

Ahora OpenAI ha reunido estas ideas y ha construido dos nuevos modelos, llamados DALL · E y CLIP , que combinan lenguaje e imágenes de una manera que hará que las IA comprendan mejor las palabras y a qué se refieren.

“Vivimos en un mundo visual”, dice Ilya Sutskever, científico jefe de OpenAI. “A la larga, tendrás modelos que entiendan tanto el texto como las imágenes. La IA podrá comprender mejor el lenguaje porque puede ver el significado de las palabras y las oraciones “.

A pesar del estilo de GPT-3, su salida puede sentirse desvinculada de la realidad, como si no supiera de qué está hablando. Eso es porque no es así. Al basar el texto en imágenes, los investigadores de OpenAI y otros lugares están tratando de dar a los modelos de lenguaje una mejor comprensión de los conceptos cotidianos que los humanos usan para dar sentido a las cosas.

DALL · E y CLIP abordan este problema desde diferentes direcciones. A primera vista, CLIP (preentrenamiento de imagen y lenguaje contrastante) es otro sistema de reconocimiento de imágenes. Excepto que ha aprendido a reconocer imágenes no a partir de ejemplos etiquetados en conjuntos de datos seleccionados, como hacen la mayoría de los modelos existentes, sino a partir de imágenes y sus leyendas tomadas de Internet. Aprende lo que hay en una imagen a partir de una descripción en lugar de una etiqueta de una palabra como “gato” o “plátano”.

CLIP se entrena haciéndolo predecir qué título de una selección aleatoria de 32,768 es el correcto para una imagen determinada. Para resolver esto, CLIP aprende a vincular una amplia variedad de objetos con sus nombres y las palabras que los describen. Esto le permite identificar objetos en imágenes fuera de su conjunto de entrenamiento. La mayoría de los sistemas de reconocimiento de imágenes están capacitados para identificar ciertos tipos de objetos, como rostros en videos de vigilancia o edificios en imágenes de satélite. Al igual que GPT-3, CLIP puede generalizar entre tareas sin necesidad de formación adicional. También es menos probable que otros modelos de reconocimiento de imágenes de última generación ser engañados por ejemplos contradictorios, que han sido alterados sutilmente de formas que típicamente confunden a los algoritmos aunque los humanos no noten la diferencia.

En lugar de reconocer imágenes, DALL · E (que supongo que es un juego de palabras WALL · E / Dali) las dibuja. Este modelo es una versión más pequeña de GPT-3 que también ha sido entrenada en pares de texto-imagen tomados de Internet. Con una breve leyenda en lenguaje natural, como “una pintura de un capibara sentado en un campo al amanecer” o “una vista en sección transversal de una nuez”, DALL · E genera muchas imágenes que la coinciden: docenas de capibaras de todas las formas y tamaños frente a fondos naranjas y amarillos; fila tras fila de nueces (aunque no todas en sección transversal).

Ponte surrealista

Los resultados son sorprendentes, aunque siguen siendo heterogéneos. La leyenda “una vidriera con la imagen de una fresa azul” produce muchos resultados correctos, pero también algunos que tienen ventanas azules y fresas rojas. Otros no contienen nada que se parezca a una ventana o una fresa. Los resultados mostrados por el equipo de OpenAI en una publicación de blog no han sido seleccionados a mano, sino clasificados por CLIP, que ha seleccionado las 32 imágenes DALL · E para cada título que cree que se ajusta mejor a la descripción.

“Text-to-image es un desafío de investigación que ha existido por un tiempo”, dice Mark Riedl, quien trabaja en PNL y creatividad computacional en el Instituto de Tecnología de Georgia en Atlanta. “Pero este es un conjunto impresionante de ejemplos”.

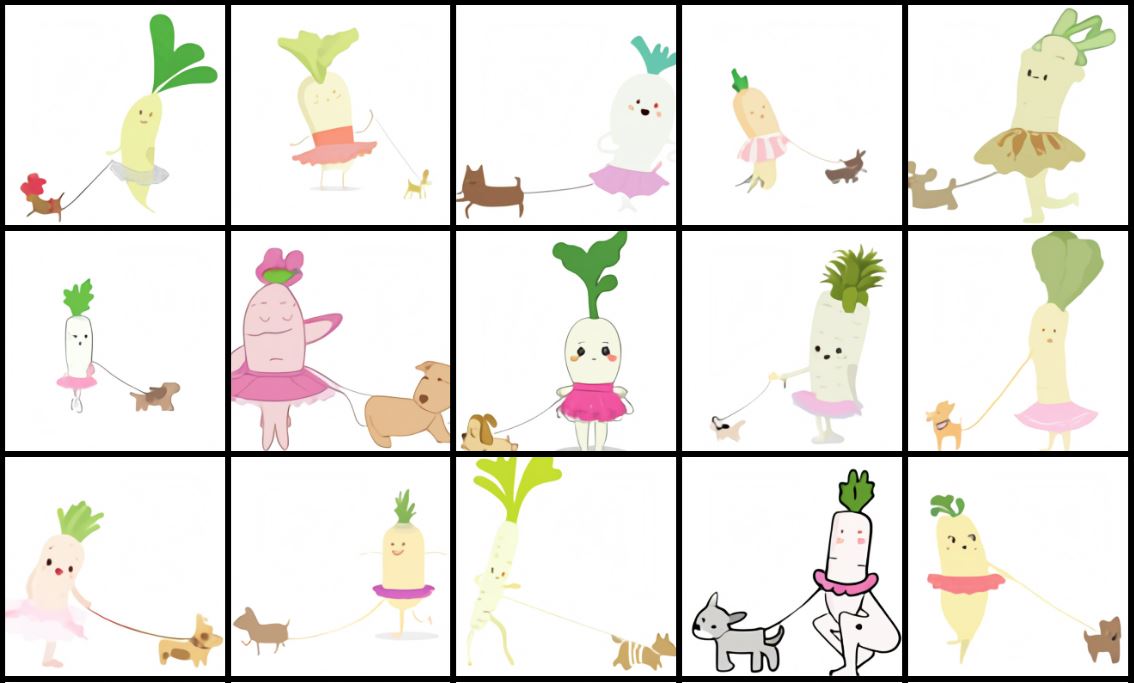

Para probar la capacidad de DALL · E para trabajar con conceptos novedosos, los investigadores le dieron subtítulos que describían objetos que pensaban que no habrían visto antes, como “un sillón de aguacate” y “una ilustración de un rábano daikon bebé con un tutú caminando perro.” En ambos casos, la IA generó imágenes que combinaron estos conceptos de manera plausible.

Los sillones en particular parecen sillas y aguacates. “Lo que más me sorprendió es que el modelo puede tomar dos conceptos no relacionados y juntarlos de una manera que resulte en algo funcional”, dice Aditya Ramesh, quien trabajó en DALL · E. Esto probablemente se deba a que un aguacate partido a la mitad se parece un poco a un sillón de respaldo alto, con el hueso como cojín. Para otras leyendas, como “un caracol hecho de arpa”, los resultados son menos buenos, con imágenes que combinan caracoles y arpas de formas extrañas.

DALL · E es el tipo de sistema que Riedl imaginó sometiéndose a la prueba Lovelace 2.0 , un experimento mental que se le ocurrió en 2014. La prueba está destinada a reemplazar la prueba de Turing como punto de referencia para medir la inteligencia artificial. Asume que una marca de inteligencia es la capacidad de combinar conceptos de manera creativa. Riedl sugiere que pedirle a una computadora que haga un dibujo de un hombre sosteniendo un pingüino es una mejor prueba de inteligencia que pedirle a un chatbot que engañe a un humano en una conversación, porque es más abierto y menos fácil de engañar.

“La verdadera prueba es ver hasta dónde se puede empujar la IA fuera de su zona de confort”, dice Riedl.

“La capacidad del modelo para generar imágenes sintéticas a partir de texto bastante caprichoso me parece muy interesante”, dice Ani Kembhavi del Instituto Allen de Inteligencia Artificial (AI2), quien también ha desarrollado un sistema que genera imágenes a partir de texto . “Los resultados parecen obedecer a la semántica deseada, lo que creo que es bastante impresionante”. Jaemin Cho, un colega de Kembhavi, también está impresionado: “Los generadores de texto a imagen existentes no han mostrado este nivel de control al dibujar múltiples objetos o las habilidades de razonamiento espacial de DALL · E”, dice.

Sin embargo, DALL · E ya muestra signos de tensión. Incluir demasiados objetos en un título aumenta su capacidad para realizar un seguimiento de qué dibujar. Y reformular un título con palabras que significan lo mismo a veces produce resultados diferentes. También hay indicios de que DALL · E está imitando imágenes que ha encontrado en línea en lugar de generar imágenes nuevas.

“Sospecho un poco del ejemplo del daikon, que sugiere estilísticamente que puede haber memorizado algo de arte de Internet”, dice Riedl. Señala que una búsqueda rápida muestra una gran cantidad de imágenes de dibujos animados de daikons antropomorfizados. “GPT-3, en el que se basa DALL · E, es conocido por memorizar”, dice.

Aún así, la mayoría de los investigadores de IA están de acuerdo en que basar el lenguaje en la comprensión visual es una buena manera de hacer que las IA sean más inteligentes.

“El futuro va a consistir en sistemas como este”, dice Sutskever. “Y ambos modelos son un paso hacia ese sistema”.