¿Debería su empresa priorizar la explicabilidad o la facilidad de implementación? Esta guía desglosa las compensaciones entre los sistemas de IA de código abierto y cerrados.

por David Gordon

- El desafío de la sala de juntas: ¿Puede explicar lo que acaba de hacer su IA?

- Modelos de código abierto frente a modelos de código cerrado

- El caso de la IA de código abierto

- El caso de la IA de código cerrado

- ¿Qué tipo de modelo de IA es mejor?

- Opacidad vs conveniencia en modelos de IA de código cerrado

- Transparencia frente a riesgo en modelos de IA de código abierto

- Veredicto final: Abierto o cerrado, ¿qué es lo correcto para usted?

- Preguntas frecuentes

- ¿Cuál es la diferencia entre los modelos de IA de código abierto y de código cerrado?

- ¿Es la IA de código abierto más segura que la IA de código cerrado?

- ¿Cómo pueden las empresas garantizar el cumplimiento al utilizar modelos de IA?

- ¿Existen plataformas empresariales que admitan modelos de IA de código abierto y de código cerrado?

- Sobre el autor

Un minorista global se prepara para la fiebre navideña con modelos de IA que pronostican el suministro y optimizan el envío. Los modelos influyen en las órdenes de compra, el personal del almacén y las promesas a los clientes en las fechas de entrega. Un ejecutivo solicita una pista de auditoría que muestre por qué el sistema está priorizando una región sobre otra. La respuesta tiene peso financiero y de reputación.

El equipo consulta a su socio de API cerrada. La interfaz muestra el tiempo de actividad, el costo y los resultados resumidos que parecen pulidos, pero el linaje de las decisiones permanece fuera de su alcance. La solicitud de transparencia se detiene en el tablero.

Un grupo interno experimenta con modelos abiertos como LLaMA 3 y Mistral. Los modelos se ejecutan dentro de entornos seguros con archivos de configuración en el control de versiones y registros que rastrean cada salida a un origen de datos. El minorista imprime informes con una ruta reproducible desde la entrada hasta el resultado. El liderazgo ve un sistema que puede usar y explicar.

Esta es la opción a la que se enfrentan ahora las empresas de todo el mundo. Los modelos de código abierto ofrecen transparencia y adaptabilidad, mientras que los modelos de código cerrado o las plataformas propietarias prometen estabilidad y pulido. La decisión tiene menos que ver con la tecnología y más con la postura: qué enfoque reduce el riesgo y gana confianza.

El desafío de la sala de juntas: ¿Puede explicar lo que acaba de hacer su IA?

Los modelos de IA de código abierto han evolucionado de curiosidades tecnológicas a contendientes empresariales. Lanzamientos como LLaMA 3 y Mistral ejemplifican la innovación rápida a través de comunidades abiertas. En comparación con las API cerradas, ofrecen:

- Ahorro de costes

- Mayor personalización

- Iteración más rápida

Para las empresas, la transparencia se ha vuelto tan valiosa como la capacidad. La presión regulatoria aumenta las apuestas en sectores como las finanzas, la atención médica y el gobierno. Se espera que las empresas rastreen el linaje de datos, proporcionen registros de auditoría y expliquen los resultados impulsados por la IA. En este entorno, los sistemas cerrados comienzan a sentirse como pasivos frágiles en lugar de lujos oscuros.

Modelos de código abierto frente a modelos de código cerrado

El análisis empírico apoya este cambio. “Los modelos de código abierto no son realmente de código abierto en el sentido de que otros diseños de software y chips sí lo son… Obtienes los pesos, pero no los datos reales que se utilizaron para producir los pesos”, dijo el Dr. Mark Nitzberg, director ejecutivo del Centro de IA Compatible con Humanos de UC Berkeley.

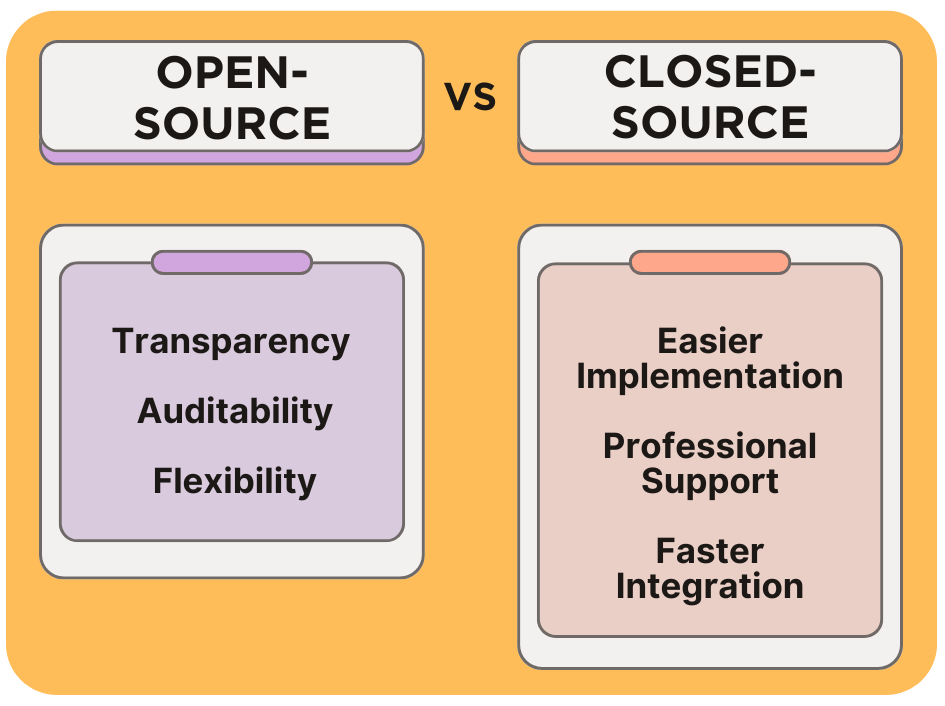

Un estudio comparativo reciente encontró que los modelos de IA de código abierto ofrecen una transparencia, auditabilidad y flexibilidad superiores, mientras que los sistemas cerrados ofrecen facilidad de implementación, soporte profesional e integración más rápida con otro software propietario.

Las plataformas cerradas como OpenAI y Gemini siguen liderando el pulido y la fiabilidad de la producción. Sin embargo, la cuestión para la empresa ya no es solo de capacidad. Se trata de si un sistema se puede explicar tan fácilmente como funciona.

La Dra. Virginia Dignum, profesora de IA Responsable en la Universidad de Umeå y directora del Laboratorio de Políticas de IA, dijo que el desafío es crear marcos más amplios para la responsabilidad compartida. “El problema no es simplemente el código abierto versus el código cerrado, sino cómo construir estructuras de gobernanza compartida: por ejemplo, apertura escalonada / contextual, acceso controlado con supervisión o marcos internacionales que garanticen tanto la seguridad como la promovida por el campo del ‘código cerrado’ y el progreso científico y la legitimidad democrática inclusiva como lo enfatiza el campo del ‘código abierto'”.

El caso de la IA de código abierto

“Los modelos de código abierto están superando a los propietarios”, dijo Yann LeCun, científico jefe de IA de Meta, después de que el R1 de DeepSeek lograra un rendimiento de referencia superior a GPT-4.

“Nuestra capacidad para obtener ingresos de esta tecnología no se ve afectada por la distribución de los modelos base en código abierto”, agregó LeCun. “De hecho, ya vemos esto: millones de descargas, miles de personas mejorando el sistema y miles de empresas creando aplicaciones. Esto claramente acelera el progreso”.

El capitalista de riesgo Marc Andreessen ha instado a Estados Unidos a liderar la IA de código abierto para preservar la soberanía tecnológica. Recientemente explicó que el control de los modelos fundamentales se conecta directamente con los valores y la confianza, especialmente en sectores donde la procedencia y el cumplimiento tienen peso.

El caso de la IA de código cerrado

El Dr. Nitzberg describió los grandes modelos de lenguaje (LLM) como “una bestia” creada a través de la alimentación de miles de millones de páginas de texto e imágenes en el entrenamiento, y luego se ajusta con el aprendizaje por refuerzo: “Le das palmaditas en la cabeza cuando su salida es buena, y la golpeas cuando su salida es mala. Esto te da una bestia que (en su mayoría) se comporta como te gustaría”.

Los defensores de las plataformas cerradas enfatizan diferentes virtudes. La confiabilidad, la integración y la responsabilidad del proveedor a menudo son más importantes para los líderes de TI que la transparencia. Es posible que una API cerrada no revele su funcionamiento interno, pero ofrece velocidad de implementación y tiempo de actividad predecible.

El resultado es una pantalla dividida. Por un lado, los sistemas abiertos ofrecen transparencia, adaptabilidad y supervisión. Por otro lado, los proveedores cerrados prometen simplicidad y pulcritud. Las empresas deben decidir qué forma de fideicomiso es más importante.

¿Qué tipo de modelo de IA es mejor?

Una empresa farmacéutica se basa en modelos abiertos, ajustándolos dentro de entornos seguros y registrando cada decisión. El costo en talento e infraestructura aumenta, pero el equipo de cumplimiento puede defender cada resultado. La confianza toma forma en la pista de auditoría.

Un minorista al otro lado de la calle firma con un proveedor cerrado. Los modelos llegan a través de API que se conectan perfectamente a los sistemas existentes. El rendimiento se siente perfecto, el tiempo de actividad es contractual y los paneles satisfacen a los ejecutivos que quieren resultados sobre la mecánica. La confianza toma forma en la relación con el proveedor.

Ambos enfoques muestran compensaciones racionales. Uno enfatiza la transparencia a través de una mayor complejidad. El otro enfatiza la conveniencia a través de servicios administrados. Cada uno refleja un cálculo diferente de control, costo y responsabilidad.

Opacidad vs conveniencia en modelos de IA de código cerrado

Muchas empresas tratan la opacidad administrada como un servicio. Bajo SLA claros, las plataformas de IA de código cerrado ofrecen:

- Selección de modelos

- Actualizaciones

- Revisiones de cumplimiento

- Respuesta a incidentes

Los equipos obtienen un rendimiento predecible, una integración sencilla y un único socio responsable de los resultados.

Los líderes de riesgo también ven una ventaja en el papeleo. El Marco de gestión de riesgos de IA del NIST fomenta las prácticas de gestión de proveedores que incluyen acuerdos de nivel de servicio e informes de certificación de terceros. Esos artefactos ayudan a las organizaciones a demostrar la supervisión de los servicios externos de IA durante las auditorías, lo que refuerza los argumentos a favor de un enfoque gestionado por el proveedor.

Una empresa de transporte ilustra este atractivo. El equipo estandarizó un proveedor cerrado, recibió actualizaciones programadas, utilizó el monitoreo integrado y mantuvo las ventanas de implementación ajustadas. Los gerentes de producto se centraron en las características del cliente mientras que el proveedor manejó el ajuste y las revisiones de seguridad. En entornos como este, la confianza crece a partir de operaciones consistentes y una cadena de responsabilidad documentada.

Transparencia frente a riesgo en modelos de IA de código abierto

Los reguladores, auditores y juntas ahora piden a las empresas que demuestren cómo sus modelos toman decisiones. Esa demanda cambia la transparencia de una característica opcional a un requisito básico.

“Publicar los pesos realmente no proporciona transparencia”, dijo el Dr. Nitzberg. “Te permite llevar a la bestia dentro de tu propia casa y entrenarla tú mismo… Pero lo que sucedió para hacer la bestia subyacente aún es desconocido para ti”.

Dignum argumentó que las preocupaciones sobre el uso malicioso de modelos abiertos a menudo se exageran. Señaló la criptografía como un campo donde los algoritmos abiertos han demostrado ser más seguros, ya que “las vulnerabilidades están expuestas y corregidas”, mientras que la seguridad a través de la oscuridad ha fallado constantemente. En su opinión, los daños causados por los lanzamientos de modelos abiertos, como la desinformación o el fraude, son en gran medida versiones a escala de los problemas existentes. “Al mismo tiempo”, agregó, “hay casi tanto daño proveniente del uso de API para modelos cerrados”.

Para Dignum, el riesgo más preocupante no radica en el mal uso, sino en la concentración de poder. “Los modelos cerrados no eliminan los daños”, dijo, “sino que aumentan considerablemente la dependencia, la falta de soberanía y la centralización del control”.

Veredicto final: Abierto o cerrado, ¿qué es lo correcto para usted?

Las plataformas cerradas atraen a clientes que desean velocidad, integración y contratos de servicio. Los modelos abiertos atraen a equipos que priorizan el control, la adaptabilidad y la visibilidad.

Es probable que el futuro mezcle ambos enfoques. En esa mezcla, la apertura funciona como la línea de base, el estándar contra el cual se enfrentará todo proveedor de IA.

Preguntas frecuentes

¿Cuál es la diferencia entre los modelos de IA de código abierto y de código cerrado?

Los modelos de IA de código abierto suelen poner su arquitectura y pesos de entrenamiento a disposición del público, lo que permite una mayor transparencia, personalización y auditabilidad. Los modelos de código cerrado son propietarios, con una visibilidad limitada de sus procesos de toma de decisiones, pero a menudo ofrecen confiabilidad de nivel empresarial, soporte de proveedores e implementación llave en mano.

¿Es la IA de código abierto más segura que la IA de código cerrado?

La seguridad depende de la implementación, no solo de la apertura. Los defensores del código abierto argumentan que el escrutinio público conduce a una detección y parcheo más rápidos de vulnerabilidades, similar al modelo utilizado en criptografía. Sin embargo, los modelos abiertos pueden exponer capacidades que los actores maliciosos pueden usar indebidamente, mientras que los modelos cerrados limitan el acceso, pero también centralizan el poder y aumentan la dependencia.

¿Cómo pueden las empresas garantizar el cumplimiento al utilizar modelos de IA?

Las empresas deben alinear sus implementaciones de IA con marcos como el Marco de Gestión de Riesgos de IA del NIST, ISO/IEC 42001 y la Ley de IA de la UE. El uso de modelos que admitan registros de auditoría, documentación, linaje de modelos y evaluaciones de riesgos de terceros es clave para demostrar el cumplimiento durante las revisiones internas y externas.

¿Existen plataformas empresariales que admitan modelos de IA de código abierto y de código cerrado?

Sí. Plataformas como Databricks, IBM Watsonx, Hugging Face y Vertex AI admiten cada vez más arquitecturas de IA híbridas. Esto permite a las empresas ejecutar modelos propietarios junto con los abiertos, aplicando políticas de gobernanza coherentes en ambos entornos.

Sobre el autor

David Gordon investiga el liderazgo ejecutivo de una firma de inversión global, trabaja como freelance en tecnología y medios y escribe historias de larga duración que hacen más preguntas de las que responden. Siempre está persiguiendo la narrativa que deshace la versión fácil de la verdad.