La automatización completa de la red aún está lejos, pero los ejecutivos de telecomunicaciones dicen que es imprescindible y saben lo que necesitan para llegar allí. ¿Pueden construir un OSS reinventado para desbloquear la innovación?

por Keith Dyer

- El requisito de las telecomunicaciones: conocimiento, topología, no solo datos

- Vista de topología de extremo a extremo de Orange

- Tú dices topología, yo digo ontología…

- DT: prometedor pero sin avances

- Un OSS reinventado como catalizador de la innovación

- DE LA TOPOLOGÍA CONCEPTUAL COMO PRÁCTICA DE LA ONTOLOGÍA

A estas alturas conocemos la historia de la empresa de telecomunicaciones nativa de la IA y cómo respalda la necesidad de romper con las limitaciones operativas actuales para poder construir nuevos modelos de negocio y beneficiarse de la tecnología innovadora en la red.

Esta semana, muchas empresas de telecomunicaciones estaban lidiando con el problema en la Cumbre OSS BSS de Ericsson en Londres, y varias de ellas identificaron un requisito común sobre cómo llegar desde donde están ahora, hasta donde quieren estar. La buena noticia es que parece haber acuerdo sobre lo que quieren. La noticia menos buena es que queda mucho trabajo para llegar allí.

Primero, volvamos a esa ortodoxia. Aquí hay una expresión de Mats Karlsson, vicepresidente y jefe de operaciones del área de soluciones y sistemas de soporte comercial.

“Las redes autónomas son la forma en que podemos ofrecer el nuevo paradigma empresarial. No es posible ofrecer servicios diferenciados a escala con una red que no está completamente automatizada. Si queremos tener SLA, necesitamos un alto grado de automatización en la red”, dijo.

La visión de las redes autónomas significa poder definir lo que en la industria hemos aprendido a llamar la intención de negocio y, con controles de circuito cerrado, crear automáticamente las políticas para orquestar los recursos necesarios para esa intención. Hacer eso directamente en una red de producción en vivo es bastante temerario, por lo que este enfoque también requiere modelar los cambios que está a punto de realizar a través de un gemelo digital de su red. Y eso, a su vez, requiere que el gemelo digital, por lo tanto, sea una representación precisa y en tiempo real de las dependencias y relaciones en su red. Después de todo, ¿qué hacer si los recursos necesarios para entregar una “intención” entran en conflicto con los recursos necesarios para mantenerse dentro de los parámetros de SLA que ha establecido para otro cliente?

Como dijo Karlsson de Ericson, esto requiere tanto la gestión del conocimiento (cómo se entienden los datos de la red y se traducen en acciones) como la observabilidad, que le brinda una visión en tiempo real de la red.

El requisito de las telecomunicaciones: conocimiento, topología, no solo datos

Y es esta pieza la que todavía está ejerciendo a las empresas de telecomunicaciones. Saben dónde están: muchos datos, codificados y estructurados de manera diversa, y / o que residen en silos. Y saben a dónde quieren llegar: poder estandarizar y estructurar esos datos para que puedan entenderlos de una manera que les brinde conocimiento en tiempo real de la red.

Es la parte intermedia la que representa el meollo del asunto. Necesitan explotar la parte de “la magia sucede aquí” de la arquitectura entre la recopilación de datos y la acción automatizada en una serie de partidas, herramientas y procesos que puedan crear ese sistema inteligente, automatizado y de circuito cerrado.

Naturalmente, eso podría incluir grandes cantidades de IA con agentes que observan, detectan, proponen, evalúan y actúan. Las tecnologías de IA de generación pueden proporcionar una interfaz conversacional para los humanos que participan en el proceso.

Ericsson describió su estrategia de IA agencial a principios de este año, y Karlsson dijo nuevamente: “Esto no es ciencia ficción. Es algo aquí y ahora, necesitamos demostrar el potencial de industrialización de las redes automatizadas”.

Pero incluso si no es ciencia ficción, las empresas de telecomunicaciones en el evento identificaron la brecha en la visión.

Vista de topología de extremo a extremo de Orange

Houda Mansour, director de automatización de redes de Orange Group, dijo que para 2030 el objetivo de Orange es tener una gestión totalmente autónoma con soluciones de circuito cerrado, intervenciones mínimas en el campo, mantenimiento predictivo y gestión basada en la intención, todo ello realizado por un equipo mucho más reducido.

Esto reduciría los tiempos de diagnóstico actuales para una falla como un corte de fibra de un promedio de tres horas y media a algo que es inmediato en el marco de tiempo.

Aunque esto es cinco años en el futuro, “esto no es futurista”, dijo, reflejando la visión de ciencia ficción de Karlsson. Pero sí describió el trabajo que Orange aún tiene que hacer.

Un problema clave son los datos, y Orange, como todos los operadores, tiene muchos: actualmente un millón de equipos con un perfil individual, un petabyte de datos generados diariamente, 2 millones de alarmas al día y 1.000 millones de CDR generados cada día.

Construir una base para la automatización a partir de esos datos requerirá “democracia de datos”, una visión unificada de los datos en sistemas dispares. El segundo fundamento es la “estructuración” de los datos por parte de los gemelos digitales para dar una mayor visibilidad, un rendimiento proactivo y una gestión para poder tomar decisiones estratégicas.

Un gemelo digital podría modelar una intención comercial en políticas de red automáticamente, con circuitos cerrados de autorreparación, corrección y verificación. Pero los gemelos digitales necesitan datos precisos, completos y en tiempo real para crear modelos en tiempo real en múltiples dominios. Houda dijo que Orange está explorando soluciones basadas en gráficos, una vista de extremo a extremo de la topología que puede representar nodos y dependencias.

Tú dices topología, yo digo ontología…

Mark Sanders, arquitecto jefe y ejecutivo de habilitación de redes autónomas de Telstra, se hizo la pregunta: “¿Qué se necesitaría para que 2026 sea recordado como el año en que las redes se volvieron verdaderamente inteligentes?” y luego dio tres respuestas.

Primero sería resolver los desafíos de los sistemas basados en la intención, que es cómo gestionar los conflictos y la optimización de recursos en competencia. En segundo lugar, asegurar la confianza en la IA, donde “probablemente no” haya confianza en dejar que la IA ejecute sistemas de circuito cerrado todavía.

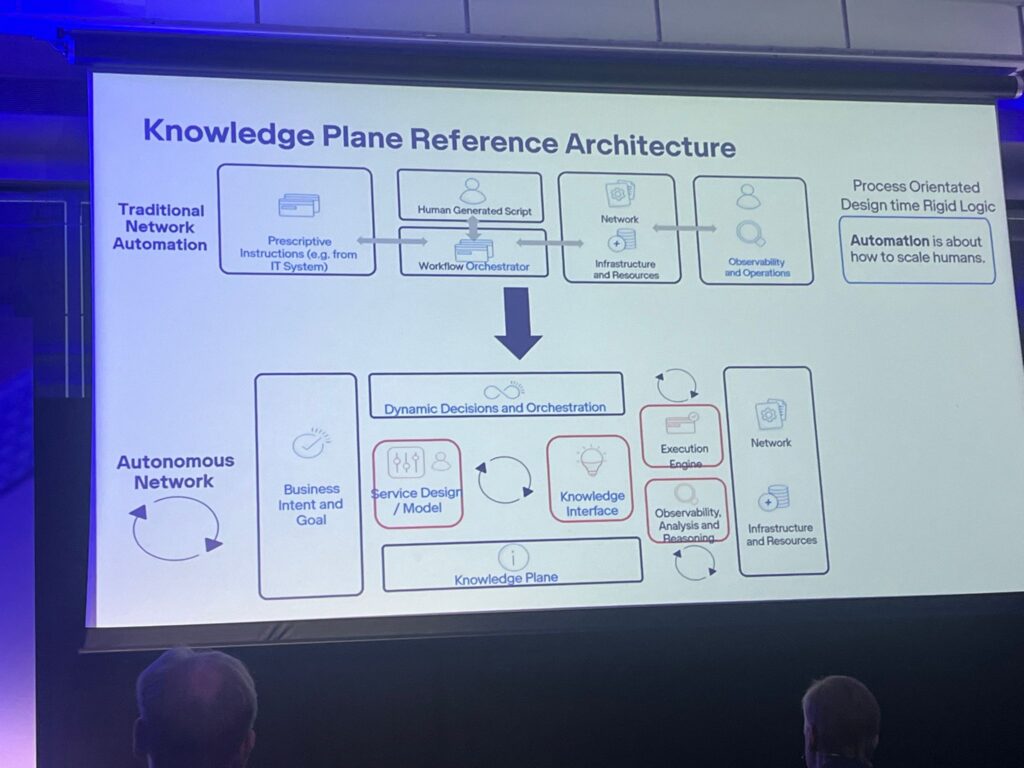

Y tercero, y quizás lo más interesante, es donde identificó la necesidad de una base para el razonamiento y la inferencia. Esto requiere poder proporcionar contexto y comprensión a través de diversos sistemas y agentes, lo que pasa de modelar datos a modelar conocimientos. Sanders denominó a esta capacidad el “Plano de conocimiento”, que se construiría codificando datos para que revelaran sus dependencias y relaciones dentro de la topología. Este plano de conocimiento sustenta una ontología que proporciona un contexto unificado para la automatización.

La ontología, dijo, proporcionaría un plano de conocimiento estructurado y explicable que fundamenta a los agentes, unifica dominios y “convierte la autonomía en un nuevo valor para el cliente”.

Si 2025 ha sido el año de la IA Agencia, el desarrollo de este Plano del Conocimiento movería a 2026 a ser el año de la Ontología, dijo Sanders.

Pero Sanders no está 100% seguro de quién construye esto, o cómo, y dijo que está buscando socios con puntos de vista similares para ayudar a definir y entregar esta parte del rompecabezas. Eso podría ser dentro del tipo de foros que TM Forum ya ofrece.

DT: prometedor pero sin avances

Otro operador que busca respuestas es Deutsche Telekom, cuyo Marcus Müller presentó un planteamiento de problema similar tanto a Sanders como a Houda.

Müller, vicepresidente de laboratorio y automatización de DT Alemania, dijo que la empresa tiene hasta 80 cadenas de servicio distintas. Como referencia, algo tan complejo como todo su servicio VoLTE representa una cadena de servicios. Cada cadena tiene un equipo dedicado responsable de ejecutar hardware, software de aplicaciones, sistemas de administración y el EMS específico del proveedor dentro de la cadena.

Eso está detrás de la decisión del operador de pasar a una arquitectura digital horizontal que sea independiente de las aplicaciones de servicio, con una plataforma común de aseguramiento y automatización de OSS que forman un conjunto de herramientas integradas y armonizadas, administradas por un solo equipo.

Sin embargo, si bien esta arquitectura proporciona muchos beneficios, por ejemplo, poder actualizar nuevo software en 20 millones de clientes en solo minutos, también presenta nuevos problemas de responsabilidad y detección de causa raíz. En lugar de haber un solo propietario de una cadena de servicios, podría haber entre 10 y 15 personas involucradas en la detección. También significa que un cambio en la infraestructura podría afectar a muchos más servicios que antes, lo que hace que sea fundamental comprender las relaciones y dependencias en la red.

Lo importante que aprendimos es que ninguno de los proveedores potenciales puede procesar datos en tiempo real a través de diferentes fuentes.

Para evitar esto, lo que DT quiere es un autobús basado en Kafka donde toda su información esté disponible, tomando, evaluando y correlacionando datos relevantes de cada cadena de servicio para ver dónde radica el problema, y luego evaluar qué servicios dependen de cualquier cambio realizado para abordar el problema.

Por lo tanto, Muller necesita un “data lakehouse” central para almacenar todos sus datos, y quiere un sistema transparente que proporcione una observabilidad completa en toda la red.

Una vez más, las tecnologías de IA y ML son la base. La IA puede ayudar mucho con la odiada tarea de la documentación, con gráficos de conocimiento para automatizar la detección de topologías y mantenerlos permanentemente actualizados.

Pero para proporcionar esa vista relacional en vivo de la red, Müller dice que DT no ha podido encontrar un sistema que le haya dado un gran avance. Ha entrenado algunos modelos con volcados de datos y ha recibido algunos comentarios prometedores, pero nada innovador, en sus palabras.

“Lo importante que aprendimos es que ninguno de los proveedores potenciales puede procesar datos en tiempo real a través de diferentes fuentes. Todos confirmaron la necesidad de un data lakehouse central como base para la observabilidad y la evaluación de la cadena de servicios.

“Nuestra idea era que alguien recopilara todos los datos en tiempo real y nos dijera lo que sucedió. Ninguno ha podido hacerlo, y todos afirmaron que necesitamos una única fuente de verdad porque otras ideas no funcionaban”.

Muller estuvo de acuerdo en que esta es una expresión similar de requisito a la súplica de Sanders por la inteligencia topológica. Y, de hecho, también es similar al requisito de Houda de Orange de una vista de extremo a extremo de la topología y las dependencias de la red.

Un OSS reinventado como catalizador de la innovación

Styf Sjöman de BT: “Más importante es el fuerte vínculo entre el papel reimaginado de OSS-BSS y la capacidad de innovar sobre estas redes”.

Entonces, en un día en que un orador asociado (un hiperescalador) dijo que lo que sería útil sería que los telos se pusieran de acuerdo y establecieran algunos requisitos comunes, de hecho había un tema común. Fue uno grande: construir observabilidad, estructurarla en sistemas topológicos que brinden a sus motores de automatización una vista ontológica en vivo y una comprensión de la red y, en consecuencia, le brinde confianza en esos motores.

Este es el objetivo de los grandes proveedores y sus socios. Las empresas de telecomunicaciones liderarán y querrán mantener la propiedad y la soberanía de sus datos y sistemas, pero no pueden construirlo por sí mismas. Observabilidad, modelado y validación en tiempo real, un contexto confiable para la IA de los agentes, controlado por interfaces intuitivas: estos son los objetivos para el nuevo OSS del futuro. Y si eso suena a ortodoxia y tarta de manzana, entonces también es el sonido de la industria tratando de dar la vuelta, innovar y aprovechar la innovación.

Como dijo Gabriela Styf Sjöman, Directora General de Investigación y Estrategia de Redes de BT Group y operadora anfitriona de la Cumbre en sus comentarios finales:

“OSS/BSS es el motor central que crea y traduce los datos en información inteligente y la capacidad de actuar sobre ellos. Pero lo más importante es el fuerte vínculo entre el papel reinventado de OSS-BSS y la capacidad de innovar sobre estas redes, y como catalizador de la innovación de productos”.

DE LA TOPOLOGÍA CONCEPTUAL COMO PRÁCTICA DE LA ONTOLOGÍA

por GONZALO SANTAYA

Si la ontología deleuziana, según afirmamos plegándonos al título de esta Colección, es una “ontología práctica” –y esto, no porque la consideremos como un cuerpo doctrinal sobre “el Ser”, que entre sus consecuencias conllevaría una reproducción o una aplicación en un ámbito externo o ajeno al pensamiento, sino porque la misma actividad en la que nos compromete su estudio es ya aplicación, una transformación de nuestra relación con las cosas y con nuestra propia subjetividad (lo cual sería ya de por sí una transformación de las cosas mismas)–, si la de Deleuze, digo, es efectivamente una ontología práctica, ¿no es a la inversa también la suya una singular práctica de la ontología?

Al poner su actividad intelectual como inmediatamente “práctica”, el filósofo deberá concebir un modo de abordarla, de pensarla, construirla y expresarla, que serán seguramente diferentes de los de aquél que la pone como una actividad eminentemente teórica cuyo único fin sería el desvelamiento discursivo de una verdad que se esconde en otro plano que el de la realidad cotidiana. Si asumimos que la ontología como discurso conceptual sobre la esencia del ser es el núcleo o la especificidad de la filosofía, y que el elemento propio de la filosofía –siguiendo a Deleuze y Guattari– es el concepto, la relación con el concepto de una ontología que se reclama como “práctica” será entonces diferente de la de una ontología que se quiere exclusivamente teórica.