Al principio de mi carrera, presencié las consecuencias de que los sistemas de salud no se comuniquen entre sí. En los hospitales, radiólogos y médicos tenían dificultades porque los sistemas de imagen no podían interconectarse. Los datos de los pacientes permanecían atrapados tras sistemas propietarios. La interoperabilidad no era solo un desafío técnico, sino también un desafío de confianza.

por Amarnath Reddy Chavva CISSP

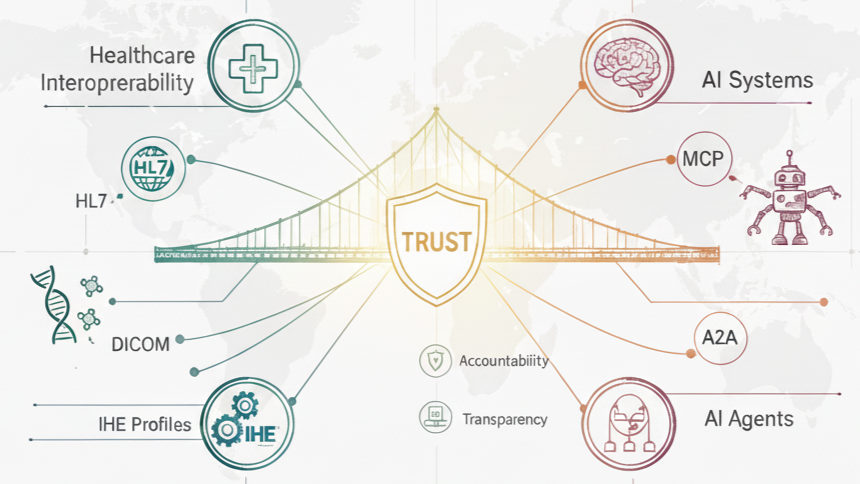

Esa experiencia marcó mis años de trabajo en interoperabilidad sanitaria : definiendo el intercambio de datos HL7, FHIR y DICOM e implementando los perfiles IHE ( Integrating the Healthcare Enterprise ) en productos y plataformas de GE Healthcare y Philips Healthcare. Los perfiles IHE simplificaron la complejidad al definir los actores, roles y transacciones IHE , y validarlos mediante Connectathons IHE : eventos presenciales donde los proveedores demostraron su capacidad para intercambiar datos de forma segura, fiable y transparente. Estos Connectathons IHE no solo crearon estándares, sino que también generaron confianza.

Hoy, al frente de la gobernanza, la ciberseguridad y el cumplimiento normativo en materia de IA , observo que la historia se repite, pero a una escala mucho mayor. La inteligencia artificial (IA) está evolucionando hacia redes de agentes autónomos que colaboran entre sí . Cada modelo, herramienta o servicio aporta fortalezas únicas; sin embargo, sin protocolos comunes, estos sistemas corren el riesgo de sufrir deriva contextual, razonamientos inconsistentes y cadenas de decisión opacas.

Aquí es donde entran en juego el Protocolo de Contexto del Modelo (MCP) y los marcos de Agente a Agente (A2A) . Definen las reglas de interacción para los agentes autónomos : cómo comparten contexto, razonan juntos y mantienen la gobernanza en lo que se está convirtiendo rápidamente en un sistema de sistemas de IA .

En muchos sentidos, MCP y A2A son para la IA lo que HL7 y DICOM fueron para la sanidad: lenguajes compartidos para la interoperabilidad. Y así como la sanidad avanzó gracias a los Connectathons de IHE, la IA necesitará sus propios Connectathons de IA : entornos reales y auditables donde los proveedores validen la colaboración, la responsabilidad y la confianza entre los agentes.

Las lecciones del sector sanitario siguen siendo atemporales: los tres pilares fundamentales de la IA responsable: • La estructura genera confianza : definir roles claros y estándares compartidos. • La rendición de cuentas genera seguridad : establecer y hacer cumplir los límites de la confianza. • La transparencia genera confianza : permitir una validación medible y repetible.

Todavía me asombra lo mucho que hemos avanzado desde que la confianza se convirtió en una responsabilidad compartida. Ese camino continúa en la IA, donde la tecnología por sí sola no basta. Debemos diseñar teniendo en cuenta la gobernanza, la auditabilidad y la interoperabilidad ética desde el principio.

Mi principal conclusión: la confianza nunca es un subproducto de la tecnología, sino el resultado de la responsabilidad compartida. Cada miembro del equipo y cada responsable político tiene un papel que desempeñar para garantizar que los sistemas de IA colaboren no solo de forma inteligente, sino también responsable.

Me encantaría escuchar a otros profesionales que trabajan en este ámbito: ¿qué desafíos de gobernanza o confianza están observando en la colaboración de IA multiagente?

Contenido seleccionado por César Guerreros (KW Foundation España)