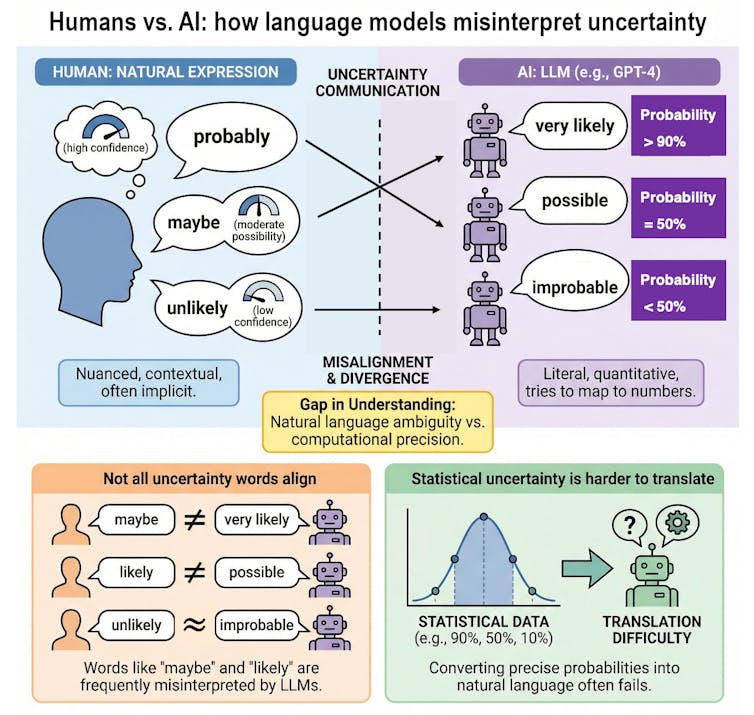

Cuando una persona dice que un evento es “probable” o “posiblemente probable”, generalmente existe un entendimiento común, aunque impreciso, de lo que eso significa. Pero cuando un chatbot de IA como ChatGPT usa la misma palabra, no evalúa las probabilidades de la misma manera que nosotros, según descubrimos mis colegas y yo.

por Mayank Kejriwal, Profesor asistente de investigación en Ingeniería Industrial y de Sistemas, Universidad del Sur de California

Recientemente publicamos un estudio en la revista NPJ Complexity que sugiere que, si bien las grandes IA de modelos de lenguaje sobresalen en la conversación, a menudo no logran sincronizarse con los humanos al comunicar incertidumbre . La investigación se centró en palabras de probabilidad estimada, que incluyen términos como “tal vez”, “probablemente” y “casi seguro”.

Al comparar cómo los modelos de IA y los humanos asignan estas palabras a porcentajes numéricos, descubrimos diferencias significativas entre los humanos y los grandes modelos de lenguaje. Si bien los modelos tienden a coincidir con los humanos en extremos como “imposible”, divergen notablemente en palabras de aproximación como “tal vez”. Por ejemplo, un modelo podría usar la palabra “probable” para representar una probabilidad del 80%, mientras que un lector humano asume que significa más cerca del 65%.

Esto podría deberse a que los humanos interpretan palabras como «probable» y «es probable» basándose más en el contexto y la experiencia personal. En cambio, los modelos de lenguaje complejos podrían estar promediando usos contradictorios de esas palabras en sus datos de entrenamiento, lo que genera discrepancias con las interpretaciones humanas.

Nuestro estudio también reveló que los modelos de lenguaje complejos son sensibles al lenguaje sexista y al idioma específico utilizado para las indicaciones. Cuando una indicación cambiaba de «él» a «ella», las estimaciones de probabilidad de la IA a menudo se volvían más rígidas, reflejando sesgos inherentes a sus datos de entrenamiento . Cuando una indicación cambiaba de inglés a chino, las estimaciones de probabilidad de la IA solían variar, posiblemente debido a las diferencias entre el inglés y el chino en la forma en que las personas expresan y comprenden la incertidumbre.

Por qué es importante

Lejos de ser una peculiaridad lingüística, esta discrepancia representa un desafío fundamental para la seguridad de la IA y la interacción entre humanos e IA. A medida que los modelos de lenguaje complejos se utilizan cada vez más en ámbitos cruciales como la atención médica , las políticas gubernamentales y la divulgación científica , la forma en que comunican el riesgo se convierte en una cuestión de confianza pública.

Si, por ejemplo, un asistente de IA que ayuda a un médico describe un efecto secundario como “improbable”, pero el cálculo interno del modelo sobre la “improbabilidad” es mucho mayor que la interpretación del médico, la decisión resultante podría ser errónea.

¿Qué otras investigaciones se están llevando a cabo?

Los científicos han estudiado cómo los humanos cuantifican la incertidumbre desde la década de 1960 , un campo impulsado por analistas de la CIA para mejorar los informes de inteligencia. Más recientemente, se ha producido un auge en la literatura sobre modelos de lenguaje a gran escala que busca comprender a fondo las redes neuronales para entender mejor sus “comportamientos” y patrones lingüísticos.

Nuestro estudio añade una capa de complejidad al tratar la interacción entre humanos e inteligencia artificial como un sistema similar al biológico, donde el significado puede degradarse. Va más allá de simplemente medir si una IA es “inteligente” y, en cambio, se pregunta si está alineada.

Otros investigadores están explorando si la llamada “guía de razonamiento” —que consiste en pedirle a la IA que muestre su proceso— puede corregir estos errores. Sin embargo, nuestro estudio reveló que incluso el razonamiento avanzado no siempre logra salvar la brecha entre los datos estadísticos y las etiquetas verbales.

¿Qué sigue?

Un objetivo para el desarrollo futuro de la IA es crear modelos que no solo predigan la siguiente palabra probable, sino que comprendan el peso de la incertidumbre que transmiten. Los investigadores abogan por métricas de consistencia más sólidas para garantizar que, si un modelo detecta una probabilidad del 10 % en los datos, elija siempre la misma palabra.

A medida que avanzamos hacia un mundo donde la IA resume artículos científicos y gestiona las agendas de las personas, asegurarnos de que “probablemente” signifique “probablemente” es un paso vital para convertir a estos sistemas en socios fiables en lugar de simples loros sofisticados.

Fuente: https://theconversation.com/probably-doesnt-mean-the-same-thing-to-your-ai-as-it-does-to-you-275626