Los reportes de imágenes y videos íntimos publicados en internet sin consentimiento van en aumento, y los deepfakes añaden una nueva y terrible dimensión al problema. Exempleados de Google señalan que han luchado para que los directivos actúen al respecto.

por Paresh Dave

A principios de 2022, dos miembros del personal de políticas de Google se reunieron con un trío de mujeres víctimas de una estafa que hizo que circularan por internet videos explícitos de ellas, incluso a través de los resultados de búsqueda de Google. Ellas se encontraban entre las cientos de jóvenes adultas que respondieron a anuncios que buscaban modelos de trajes de baño para ser obligadas a actuar en contenidos sexuales distribuidos por el sitio web GirlsDoPorn. La página cerró en 2020, y un productor, un contador y un camarógrafo se declararon culpables de tráfico sexual, pero los videos seguían apareciendo en los resultados de Google más rápido de lo que las mujeres podían solicitar su eliminación.

Las mujeres, a las que se unieron un abogado y un experto en seguridad, presentaron una gran cantidad de ideas sobre cómo Google podría ocultar mejor los clips ofensivos y denigrantes, según cinco personas que asistieron a la reunión virtual o fueron informadas de ella. Querían que el buscador de Google prohibiera los sitios web dedicados a GirlsDoPorn y los videos con su marca de agua. Sugirieron que Google tomara prestado el disco duro de 25 terabytes en el que el consultor de ciberseguridad de las mujeres, Charles DeBarber, había guardado todos los contenidos de GirlsDoPorn, creara una huella dactilar matemática, o “hash”, de cada clip y los bloqueara para que nunca volvieran a aparecer en los resultados de las búsquedas.

Los dos empleados de Google presentes en la reunión esperaban utilizar lo que habían aprendido para obtener más recursos de los altos mandos. Pero el abogado de la víctima, Brian Holm, se marchó con dudas. El equipo de políticas de la empresa se encontraba en “una situación difícil” y “no tenía autoridad para efectuar cambios dentro de Google”, comparte.

Su instinto le dio la razón. Dos años después, ninguna de las ideas planteadas en la reunión se ha puesto en práctica, y los videos siguen apareciendo en los resultados de las búsquedas.

Imágenes íntimas no consentidas: un problema creciente en el buscador de Google

WIRED habló con cinco exempleados de Google y 10 defensores de las víctimas que han estado en comunicación con la empresa. Todos ellos mencionan que agradecen que, debido a los recientes cambios introducidos por Google, las supervivientes de abusos sexuales cometidos con imágenes, como la estafa de GirlsDoPorn, consigan eliminar con mayor facilidad y éxito los resultados no deseados de las búsquedas. Pero les frustra que la dirección de la gigante tecnológica no haya aprobado las propuestas, como la idea del disco duro, que consideran que restablecería y preservaría mejor la privacidad de millones de victimas de todo el mundo, la mayoría de ellas mujeres.

Las fuentes describen deliberaciones internas de las que no se había informado anteriormente, incluida la justificación de Google para no emplear una herramienta del sector denominada StopNCII que comparte información sobre imágenes íntimas no consentidas (NCII, por sus siglas en inglés) y el hecho de que la compañía no exigiera que los sitios web pornográficos verificaran el consentimiento para obtener tráfico de estas búsquedas. El propio equipo de investigación de Google ha publicado medidas que las empresas tecnológicas pueden adoptar contra las NCII, incluido el uso de StopNCII.

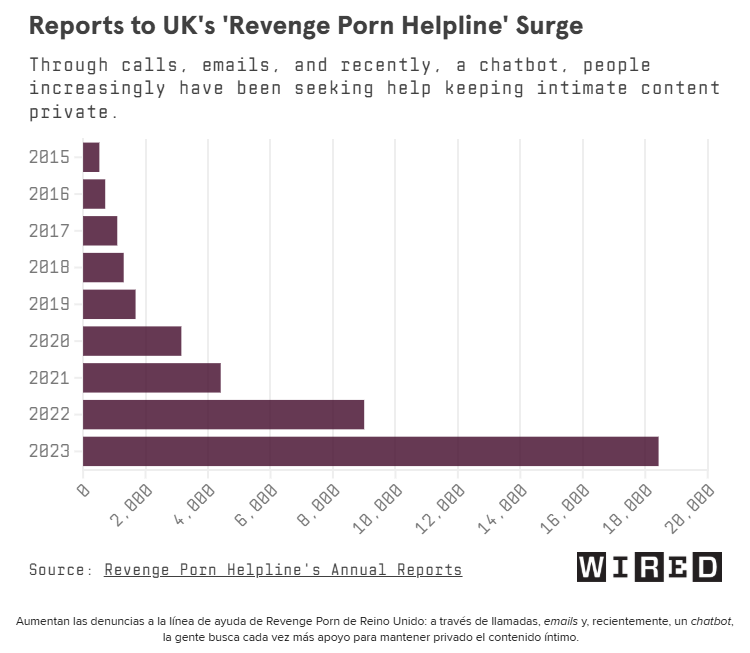

Asimismo, las fuentes creen que tales esfuerzos contendrían mejor un problema que va en aumento, en parte gracias a la ampliación del acceso a herramientas de inteligencia artificial (IA) que generan deepfakes explícitos, incluidos los de las supervivientes de GirlsDoPorn. El número total de denuncias a la línea de ayuda Revenge Porn de Reino Unido se incrementó en más del doble el año pasado, hasta aproximadamente 19,000, al igual que el número de casos relacionados con contenido sintético. A la mitad de los más de 2,000 británicos que participaron en una encuesta reciente les preocupaba ser víctimas de deepfakes. En mayo, la Casa Blanca instó a los legisladores y a la industria a tomar medidas más rápidas para frenar las NCII en general. En junio, Google se unió a otras siete compañías y nueve organizaciones en el anuncio de un grupo de trabajo para coordinar las acciones.

Aumentan las denuncias a la línea de ayuda de Revenge Porn de Reino Unido: a través de llamadas, emails y, recientemente, un chatbot, la gente busca cada vez más apoyo para mantener privado el contenido íntimo.

En la actualidad, las víctimas pueden exigir el enjuiciamiento de los agresores o emprender acciones legales contra los sitios web que alojan esta clase de contenidos, pero ninguna de esas vías garantiza nada, y ambas pueden resultar costosas debido a los honorarios de los abogados. Conseguir que Google elimine los resultados sería la táctica más práctica y serviría al objetivo último de mantener el material infractor fuera del alcance de amigos, jefes de contratación, posibles arrendadores o citas, quienes probablemente recurran a Google para buscar información sobre las personas.

En la actualidad, las víctimas pueden exigir el enjuiciamiento de los agresores o emprender acciones legales contra los sitios web que alojan esta clase de contenidos, pero ninguna de esas vías garantiza nada, y ambas pueden resultar costosas debido a los honorarios de los abogados. Conseguir que Google elimine los resultados sería la táctica más práctica y serviría al objetivo último de mantener el material infractor fuera del alcance de amigos, jefes de contratación, posibles arrendadores o citas, quienes probablemente recurran a Google para buscar información sobre las personas.

Una representante de Google, quien solicitó el anonimato para evitar el acoso de los autores, declinó hacer comentarios sobre la llamada con las víctimas de GirlsDoPorn. Asegura que la lucha contra lo que la empresa denomina imágenes explícitas no consentidas (NCEI, por sus siglas en inglés) sigue siendo una prioridad y que las acciones de Google van mucho más allá de lo que exige la ley. “A lo largo de los años, hemos invertido mucho en políticas y mecanismos líderes en el sector para ayudar a proteger a las personas afectadas por este contenido perjudicial”, afirma. “Los equipos de todo Google siguen trabajando con diligencia para reforzar nuestras medidas y abordar cuidadosamente los nuevos retos para proteger mejor a las personas”.

En una entrevista con WIRED, un director de producto de Google Search que supervisa el trabajo contra las amenazas explica que el bloqueo de videos mediante hashes es difícil de adoptar porque algunos sitios web no publican los clips de forma que los motores de búsqueda puedan compararlos. Hablando bajo condición de anonimato, indica que Google ha animado a las páginas de contenido explícito a solucionar este problema. Añade que, en general, Google tiene más trabajo por hacer, pero refuta la acusación de que los directivos hayan retrasado la labor.

Los defensores de una acción más audaz por parte de Google señalan las restricciones mucho más rigurosas de la compañía en cuanto a las búsquedas de material de abuso sexual infantil (CSAM, por sus siglas en inglés) como prueba de que podría hacer mucho más. Al escribir “deepfake nudes kids” en Google, aparece una advertencia de que dicho contenido es ilegal y, en última instancia, dirige a los usuarios a artículos de noticias y grupos de apoyo. Al año, Google también encuentra y bloquea de sus resultados casi un millón de nuevas páginas web que contienen CSAM.

Una búsqueda realizada recientemente en Google sobre “deepfake nudes jennifer aniston” arrojó siete resultados que pretendían mostrar precisamente eso. El buscador no ofreció ningún aviso ni recursos en respuesta a la consulta, a pesar de que casi todos los estados de EE UU y muchos países han tipificado como delito la distribución no permitida de contenido íntimo de adultos. Google no quiso hacer comentarios sobre la ausencia de advertencias.

El responsable de producto sostiene que las comparaciones con el CSAM no son válidas. Prácticamente cualquier imagen de un niño desnudo es ilegal y puede eliminarse automáticamente, destaca. Separar las NCEI de la pornografía consensuada requiere algún indicador de que el contenido fue grabado o distribuido sin permiso, y ese contexto a menudo no está claro hasta que una víctima presenta una denuncia y un humano la analiza. Pero el representante de Google no quiso responder directamente si la empresa ha intentado aportar una solución a dicha situación.

Adam Dodge, fundador del grupo de defensa y educación Ending Tech-Enabled Abuse, considera que, hasta que Google elimine proactivamente más NCII, las víctimas tienen que mantenerse hipervigilantes para encontrarlas y denunciarlas por sí mismas. Eso “no es algo que debamos imponer a las víctimas”, resalta. “Les pedimos que acudan al espacio donde fueron agredidas digitalmente para superar el trauma”.

La pornografía deepfake impulsada por IA está fuera de control

Una nueva investigación revela que el número de videos deepfake se está disparando y que los mayores motores de búsqueda del mundo dirigen los clics a docenas de sitios dedicados a las falsificaciones de IA no autorizadas.

Acciones de Google contra las imágenes explícitas no consentidas

Google comenzó a aceptar solicitudes de eliminación de resultados de búsqueda que condujeran a desnudos o relaciones sexuales en 2015 si el contenido estaba destinado a ser privado y nunca se autorizó su publicación, de acuerdo con su política. Esto se mantuvo prácticamente sin cambios hasta 2020, cuando la compañía añadió la categoría de “estado íntimo”.

Una columna de The New York Times de ese año, titulada “The Children of Pornhub”, hizo que los directivos de Google dedicaran recursos al tema, organizando proyectos, incluido uno con nombre en clave Sparrow, para ayudar a las víctimas a mantener el contenido fuera de las búsquedas para siempre, según afirman tres exempleados. El director de producto confirmó que, en ocasiones, los ejecutivos han presionado a los equipos para mejorar la gestión de Google de las NCEI.

Una representante de Google, quien solicitó el anonimato para evitar el acoso de los autores, declinó hacer comentarios sobre la llamada con las víctimas de GirlsDoPorn. Asegura que la lucha contra lo que la empresa denomina imágenes explícitas no consentidas (NCEI, por sus siglas en inglés) sigue siendo una prioridad y que las acciones de Google van mucho más allá de lo que exige la ley. “A lo largo de los años, hemos invertido mucho en políticas y mecanismos líderes en el sector para ayudar a proteger a las personas afectadas por este contenido perjudicial”, afirma. “Los equipos de todo Google siguen trabajando con diligencia para reforzar nuestras medidas y abordar cuidadosamente los nuevos retos para proteger mejor a las personas”.

De acuerdo con las fuentes, Google ha hecho que su formulario de eliminación sea más fácil de usar, entender y acceder. La gigante de las búsquedas eliminó la jerga legal y el uso obsoleto del término “porno de venganza (revenge porn)”, ya que la pornografía se considera generalmente consensuada. La compañía añadió instrucciones para enviar capturas de pantalla y más detalles sobre el proceso de revisión.

Se puede acceder al formulario haciendo clic en el menú que aparece junto a cada resultado de búsqueda. Las solicitudes se multiplicaron por 19 en una de las primeras pruebas, según una fuente. Un segundo informante indica que se ha convertido en uno de los formularios de Google más empleados para denunciar abusos y que, tras las modificaciones, un porcentaje mucho mayor de solicitudes dio lugar a la eliminación de resultados. Google cuestiona estas cifras, pero se negó a compartir datos detallados sobre las NCEI.

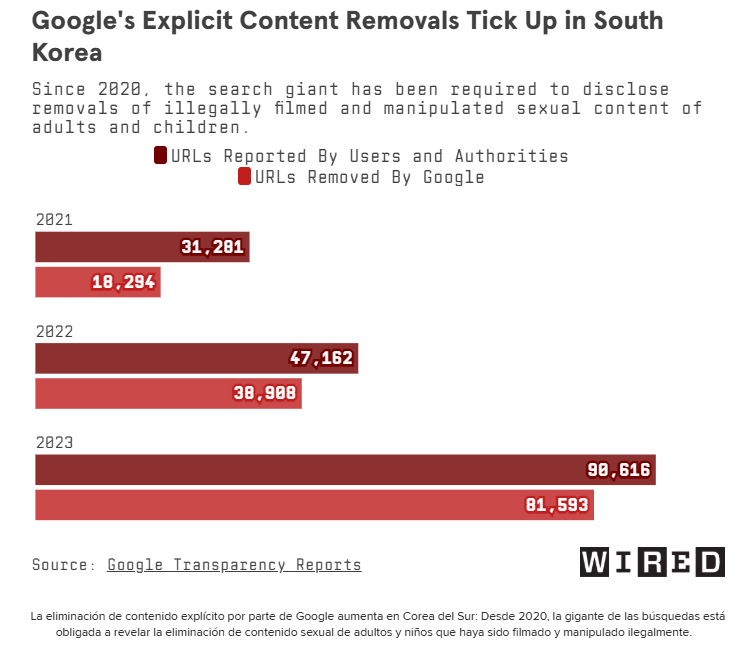

Los informes de transparencia exigidos por el gobierno de Corea del Sur muestran que Google ha eliminado la mayoría de los casi 170,000 enlaces de búsqueda y de YouTube denunciados por contenido sexual no deseado en ese país desde diciembre de 2020, los primeros datos disponibles, y ha retirado casi 300 contenidos en respuesta a 380 denuncias de usuarios en India desde mayo de 2021. La escasez de información sugiere que Google está encontrando más denuncias creíbles que su rival más pequeño en búsquedas Microsoft, que tomó medidas en el 52% de los casi 8,400 casos que recibió globalmente para Bing y otros servicios desde 2015 hasta junio de 2023.

La eliminación de contenido explícito por parte de Google aumenta en Corea del Sur: Desde 2020, la gigante de las búsquedas está obligada a revelar la eliminación de contenido sexual de adultos y niños que haya sido filmado y manipulado ilegalmente.

Tráfico web a partir de contenido explícito no consensuado

El sistema StopNCII, lanzado a finales de 2021, ha acumulado una base de datos de más de 572,000 fotos y videos con hashes y ha impedido que se compartan más de 12,000 veces en 10 servicios, incluidos Instagram y TikTok. Según tres fuentes, Google no ha adoptado la herramienta para bloquear contenidos en las búsquedas por temor a lo que realmente contiene dicha base.

Para proteger la privacidad de las víctimas, StopNCII no revisa el material que se denuncia, y los hashes no revelan nada sobre el contenido subyacente. A Google le preocupa que acabe bloqueando algo inofensivo, declaran las fuentes. “No sabemos si es solo una imagen de un cupcake”, comenta una de ellas. Y añaden que Google también ha optado por no financiar un sistema que considera superior, a pesar de las sugerencias internas de hacerlo.

El representante de Google declinó hacer comentarios sobre StopNCII, pero en abril la compañía comunicó a los legisladores de Reino Unido que cuestionaron a Google sobre su decisión de no utilizar la herramienta que tenía “preocupaciones políticas y prácticas específicas sobre la interoperabilidad de la base de datos”, sin dar más detalles.

Internamente, a los trabajadores de Google se les han ocurrido algunas ideas arriesgadas para mejorar la eliminación de contenido. Los empleados han debatido la posibilidad de retirar los sitios web explícitos, incluidas las empresas pornográficas, de los resultados de las búsquedas, a menos que estén dispuestos a garantizar que su contenido es consensuado, según cuatro fuentes. La idea no se ha adoptado. La unidad de Google encargada de las búsquedas ha evitado establecer normas sobre un tema delicado y tabú como las imágenes sexuales, sostienen tres informantes. “No quieren ser vistos como reguladores de internet”, destaca un exempleado.

Dado que Google dirige un tráfico importante a sitios web de contenido explícito, podría obligarles a tomar medidas más estrictas. Alrededor del 15% de las búsquedas de imágenes y hasta la mitad de las de videos entre los miles de millones que Google recibe a diario están relacionadas con la pornografía, resalta un exempleado, cifras sobre las que la compañía declinó hacer comentarios. “Google tiene las llaves del reino”, afirma la fuente. Mientras tanto, pocos intervienen. Los legisladores de Estados Unidos no han aprobado la normativa propuesta para imponer controles de consentimiento a las cargas de contenido online. Y algunos servicios populares para compartir material explícito, como Reddit y X, no exigen a los usuarios que presenten pruebas del consentimiento de los sujetos.

X ahora permite difundir contenidos para adultos y va por el negocio de OnlyFans

El ajuste en las políticas de uso de X avivan las preocupaciones sobre su capacidad de controlar la difusión de contenidos dañinos.

Los productores de pornografía, que recopilan información sobre la identidad de los artistas, tal como exige la legislación de Estados Unidos, apoyan que se comparta un indicador de consentimiento con los motores de búsqueda, destaca Mike Stabile, vocero de Free Speech Coalition. “Los principales sitios para adultos ya controlan y bloquean las NCII de forma mucho más agresiva que las plataformas convencionales”, subraya.

El representante de Google se negó a comentar la idea del consentimiento, pero señala una sanción ya existente: El pasado mes de diciembre, Google empezó a descender, aunque no a bloquear, los resultados de búsqueda de los sitios web que aparecían en “un gran volumen” de solicitudes de eliminación aceptadas.

Derecho a solicitar que Google elimine el contenido explícito

El director de producto de Google y el vocero defienden que el equipo de búsquedas ya ha dado grandes pasos en los últimos tres años para aliviar la carga que soportan las supervivientes de agresiones sexuales mediante imágenes no consensuadas. Pero la investigación de WIRED muestra que algunas mejoras se han dado con algunas salvedades.

Un sistema implantado por Google que intenta eliminar automáticamente los enlaces asociados a la búsqueda cuando el contenido denunciado anteriormente reaparece en nuevos sitios web no funciona con los videos ni con las imágenes alteradas, y dos fuentes manifiestan que Google no había dedicado personal a perfeccionarlo. “Podría ser absolutamente mejor, y no se presta suficiente atención a cómo podría resolver de verdad los problemas de las víctimas”, opina una de ellas. El representante aclara que se ha asignado personal para optimizar la herramienta.

Otro sistema denominado protección de víctimas conocidas intenta filtrar los resultados que muestran imágenes explícitas de las consultas de búsqueda similares a las de anteriores solicitudes de eliminación, indican las dos fuentes. Está diseñado para no alterar los resultados que dirigen a pornografía legítima y, en general, reduce la necesidad de que las víctimas estén atentas a nuevas subidas de contenido. Pero Google ha reconocido a los reguladores surcoreanos que el sistema no es perfecto. “Dada la naturaleza dinámica y siempre cambiante de la web, los sistemas automatizados no son capaces, el 100% de las veces, de captar todos los resultados explícitos”, escribe la compañía en sus informes de transparencia.

En uno de sus mayores cambios, Google abandonó el pasado agosto su política de negarse a eliminar enlaces a contenidos que incluyeran muestras de que habían sido grabados con consentimiento. Durante años, si Google determinaba, a partir de las imágenes y el audio, que el sujeto sabía que estaba siendo grabado sin señales de coerción o angustia, rechazaba la petición de eliminación a menos que el solicitante aportara pruebas fehacientes de que se había publicado sin autorización. Era un “concepto muy vago”, resalta uno de los exempleados.

Esa misma fuente sostiene que el personal persuadió a los directivos para que actualizaran la política, en parte describiéndoles la importancia de permitir que las personas que se habían convertido en artistas para adultos en OnlyFans por necesidad económica revocaran posteriormente su consentimiento y deshicieran cualquier vínculo con el trabajo sexual. El representante de Google no lo refutó.

El National Center on Sexual Exploitation (Centro Nacional sobre Explotación Sexual), con sede en Washington DC, un grupo que lucha contra la pornografía y que se ha convertido en una autoridad en materia de delitos sexuales cometidos con imágenes, sostiene que, incluso después de la revisión, Google se está quedando corto. Quiere que la gigante tecnológica atienda automáticamente todas las solicitudes de eliminación y haga recaer en los sitios web la responsabilidad de demostrar que hubo consentimiento para grabar y publicar el contenido en cuestión. El representante de Google asegura que se están estudiando constantemente posibles actualizaciones de la política.

En opinión de los abogados, Google no está siendo en absoluto tan ingenioso o atento como podría o debería ser. Brad Gilde, del despacho de abogados Gilde de Houston, comenta que se sintió decepcionado cuando su cliente ganó una sentencia por valor de 1,200 millones de dólares contra un exnovio el pasado agosto, pero luego no pudo conseguir que Google eliminara un enlace de búsqueda de alto rango a una grabación de audio sexualmente explícita de ella en YouTube. La publicación, que incluía el nombre de la víctima y obtuvo más de 100 visitas, se retiró el mes pasado únicamente después de que WIRED indagara al respecto.

Desarrollar un sistema de IA fiable para identificar proactivamente los contenidos multimedia no consensuados puede resultar imposible. Pero estar más pendientes de los casos más graves no debería ser demasiado complicado, resalta Dan Purcell, una víctima que fundó la empresa de remoción de contenido Ceartas DMCA. Los empleados de Google hicieron una propuesta al respecto: La compañía establecería un programa de señalización prioritaria, como ha hecho con otros tipos de contenido problemático, incluido el CSAM, y solicitar formalmente avisos a organizaciones externas como la de Purcell, que vigilan las NCII. Pero la dotación de personal para administrar la idea nunca llegó. “Google es la plataforma de descubrimiento nº 1”, señala Purcell. “Tienen que asumir más responsabilidad”. El vocero de Google declinó hacer comentarios.

DeBarber, el consultor de eliminación de material explícito que habló con Google junto a sus clientes víctimas de GirlsDoPorn, hizo una búsqueda de una de ellas este mes mientras hablaba por teléfono con WIRED. No aparecieron enlaces a videos de ella, porque DeBarber ha dedicado más de 100 horas a conseguir que se retiren esas páginas. Pero un servicio de pornografía usaba indebidamente su nombre para atraer a los espectadores a otros contenidos, un nuevo resultado que DeBarber tendría que pedir a Google que suprimiera. Y a través de otra búsqueda en Google, logró acceder a un sitio web cuestionable en el que la gente puede buscar videos de su cliente.

Los acosadores envían regularmente a esa clienta mensajes de texto con enlaces a sus NCII, un frustrante recordatorio de que su pasado aún no se ha borrado. “Quieren desaparecer de la vista y de la mente”, destaca DeBarber de sus clientes. “Vamos en la dirección correcta”. Pero él y los supervivientes cuentan con que Google ayude a acabar con los agresores para siempre. “Google pudo haber hecho mucho más y aún puede hacerlo”.

Las banderas rojas que señalan un Deepfake

Desde palabras habladas sin sentido hasta demasiados dedos o bocas “extrañas”. Son algunos detalles útiles para reconocer fotos y videos generados por IA.

También te puede interesar…

- Así funciona un refugio pesquero en el Golfo de México. Su meta: dejar descansar al mar.

- Todo lo que necesitas saber sobre el DOGE de Elon Musk.

- Entrevista con Jeff Dean, el arquitecto de la IA que moldea el futuro de Google (y del mundo).

- Este nuevo chip cerebral impulsado con IA de Nvidia busca desbancar a Neuralink.

- Una charla con Gerardo del Villar, fotógrafo subacuático: “Es entre tiburones donde realmente soy yo”.