Los cables que conectan las neuronas actúan como “minicomputadoras” independientes para almacenar diferentes tipos de información.

por Shelly Fan

Las reglas del cerebro parecen simples: disparar juntos, conectar juntos.

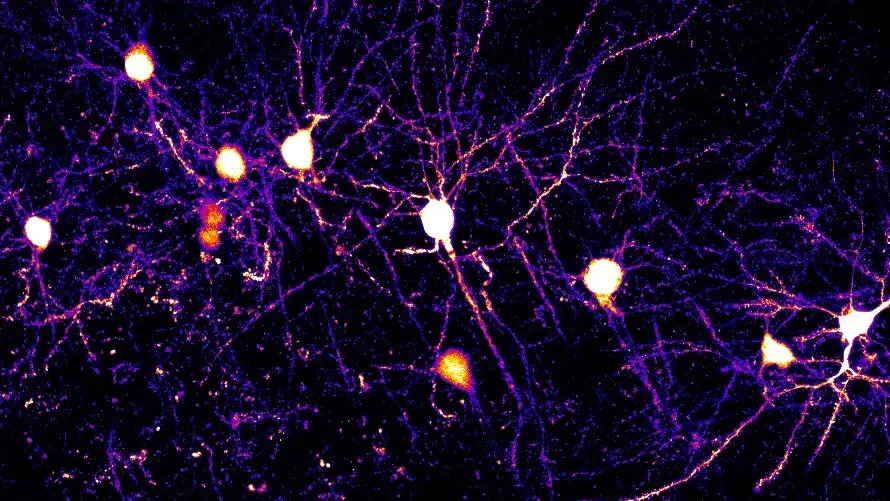

Cuando los grupos de neuronas se activan, se interconectan. Esta red neuronal es la que nos permite aprender, razonar, formar recuerdos y adaptarnos al mundo, y es posible gracias a las sinapsis, pequeñas uniones que se encuentran en las ramificaciones neuronales y que reciben y transmiten información de otras neuronas.

A menudo se ha dicho que las neuronas son las unidades computacionales del cerebro. Sin embargo, estudios más recientes sugieren que no es así. Sus cables de entrada, llamados dendritas, parecen ejecutar sus propios cálculos , y estos alteran el funcionamiento de las neuronas y sus redes asociadas.

Un nuevo estudio publicado en Science arroja luz sobre el funcionamiento de estas “minicomputadoras”. Un equipo de la Universidad de California en San Diego observó cómo se activaban las sinapsis en el cerebro de un ratón mientras este aprendía una nueva habilidad motora. Según su ubicación en las dendritas de una neurona, las sinapsis seguían reglas diferentes. Algunas buscaban establecer conexiones locales. Otras formaban circuitos más largos.

“Nuestra investigación proporciona una comprensión más clara de cómo se modifican las sinapsis durante el aprendizaje”, afirmó el autor del estudio, William “Jake” Wright, en un comunicado de prensa.

El trabajo ofrece una visión del funcionamiento de cada neurona al codificar recuerdos. «La adquisición, el almacenamiento y la recuperación constantes de recuerdos se encuentran entre las características más esenciales y fascinantes del cerebro», escribieron Ayelén I. Groisman y Johannes J. Letzkus, de la Universidad de Friburgo (Alemania), quienes no participaron en el estudio.

Los resultados podrían brindar información sobre el “aprendizaje fuera de línea”, como cuando el cerebro graba recuerdos fugaces en otros más permanentes durante el sueño, un proceso que aún no comprendemos por completo.

También podrían inspirar nuevos métodos de IA. La mayoría de los algoritmos actuales basados en el cerebro tratan cada neurona artificial como una sola entidad con sinapsis que siguen el mismo conjunto de reglas. Ajustar estas reglas podría impulsar una computación más sofisticada en cerebros mecánicos.

Un bosque neuronal

Abra un libro de texto de neurociencia y verá el dibujo de una neurona. El extremo receptor, la dendrita, se asemeja a las densas ramas de un árbol. Estas ramas canalizan señales eléctricas hacia el cuerpo celular. Otra rama transmite los mensajes salientes a las células vecinas.

Pero las neuronas tienen múltiples formas y tamaños. Algunas, rechonchas, crean circuitos locales mediante ramificaciones muy cortas. Otras, como las células piramidales, tienen dendritas largas y fibrosas que se extienden hacia la parte superior del cerebro como el brócoli. En el otro extremo, se forman arbustos para captar información de regiones cerebrales más profundas.

A lo largo de todas estas ramas se encuentran pequeños núcleos llamados sinapsis. Los científicos saben desde hace tiempo que las sinapsis se conectan durante el aprendizaje. Aquí, las sinapsis afinan sus conexiones moleculares para estar más o menos dispuestas a conectarse con las sinapsis vecinas.

Pero ¿cómo saben las sinapsis qué ajustes contribuyen mejor a la actividad general de la neurona? La mayoría solo capta información local, pero de alguna manera se unen para modificar la producción de la célula. «Cuando se habla de plasticidad sináptica, normalmente se considera uniforme en el cerebro», afirmó Wright. Pero el aprendizaje se produce inicialmente en sinapsis individuales, cada una con su propia personalidad.

Los científicos han buscado la respuesta a esta pregunta —conocida como el problema de asignación de créditos— observando un puñado de neuronas en una placa o realizando simulaciones. Sin embargo, las neuronas de estos estudios no forman parte de las redes cerebrales que utilizamos para aprender, codificar y almacenar recuerdos, por lo que no pueden captar la contribución de las sinapsis individuales.

Doble equipo

En el nuevo estudio, los investigadores añadieron genes a ratones para poder monitorear sinapsis individuales en la región cerebral implicada en el movimiento. Después, entrenaron a los ratones para que presionaran una palanca y obtuvieran un premio con agua.

Durante dos semanas, el equipo capturó la actividad de las células piramidales (las que tienen largas ramas en un extremo y arbustos en el otro). En lugar de observar únicamente la actividad de cada neurona en su conjunto, el equipo también observó las sinapsis individuales a lo largo de cada dendrita.

No se comportaron de la misma manera. Las sinapsis de la rama más larga, más cercana a la parte superior del cerebro (conocida como dendrita apical), se sincronizaron rápidamente con las vecinas. Sus conexiones se fortalecieron y formaron una red más densa.

“Esto indica que la plasticidad relacionada con el aprendizaje está gobernada por interacciones locales entre entradas sinápticas cercanas en las dendritas apicales”, escribieron Groisman y Letzkus.

Por el contrario, las sinapsis en las dendritas basales con forma de arbusto fortalecieron o debilitaron sus conexiones en sintonía con la actividad general de la neurona.

El cuerpo celular de una neurona, del cual brotan las dendritas, también es una máquina de computación. En otro experimento, al bloquear la acción del cuerpo celular, se redujeron drásticamente las señales de las dendritas basales, pero no las de las apicales. En otras palabras, las sinapsis de la neurona funcionaban de forma diferente según su ubicación. Algunas seguían la actividad global de la célula; otras se preocupaban más por los problemas locales.

“Este descubrimiento cambia fundamentalmente la forma en que entendemos cómo el cerebro resuelve el problema de asignación de créditos, con el concepto de que las neuronas individuales realizan cálculos distintos en paralelo en diferentes compartimentos subcelulares”, dijo el autor principal del estudio, Takaki Komiyama, en el comunicado de prensa.

Este trabajo se suma a otros esfuerzos que demuestran la complejidad del cerebro. Lejos de ser una unidad de cálculo, las ramificaciones de una neurona pueden emplear reglas flexibles para codificar recuerdos.

Esto plantea aún más preguntas.

Las dos dendritas —apical y basal— reciben distintos tipos de información de distintas áreas del cerebro. Las técnicas del estudio podrían ayudar a los científicos a identificar y desentrañar estas diferentes conexiones en red y, a su vez, a comprender mejor cómo formamos nuevos recuerdos. También resultan misteriosas las sinapsis aisladas de las dendritas apicales, que no se ven afectadas por las señales del cuerpo celular.

Una teoría sugiere que la independencia del control central podría permitir que «cada rama dendrítica funcione como una unidad de memoria independiente, aumentando considerablemente la capacidad de almacenamiento de información de las neuronas individuales», escribieron Groisman y Letzkus. Estas sinapsis también podrían ser cruciales para el «aprendizaje fuera de línea», como durante el sueño, cuando construimos recuerdos duraderos.

El equipo ahora estudia cómo las neuronas utilizan estas diferentes reglas y si cambian en casos de Alzheimer, autismo, adicciones o trastornos postraumáticos. Este trabajo podría ayudarnos a comprender mejor qué falla en estas diferentes enfermedades, afirmó Wright.