por Yevgen Chebotar y Tianhe Yu – Google DeepMind

Robotic Transformer 2 (RT-2) es un modelo novedoso de visión-lenguaje-acción (VLA) que aprende de datos web y robóticos y traduce este conocimiento en instrucciones generalizadas para el control robótico.

Los modelos de lenguaje de visión (VLM) de alta capacidad se entrenan en conjuntos de datos a escala web, lo que hace que estos sistemas sean notablemente buenos para reconocer patrones visuales o de lenguaje y operar en diferentes idiomas. Pero para que los robots alcancen un nivel similar de competencia, necesitarían recopilar datos de robots, de primera mano, en cada objeto, entorno, tarea y situación.

En nuestro artículo, presentamos Robotic Transformer 2 (RT-2), un modelo novedoso de visión-lenguaje-acción (VLA) que aprende de datos web y robóticos, y traduce este conocimiento en instrucciones generalizadas para el control robótico, al tiempo que retiene web- capacidades de escala.

Este trabajo se basa en Robotic Transformer 1 (RT-1) , un modelo entrenado en demostraciones de tareas múltiples, que puede aprender combinaciones de tareas y objetos vistos en los datos robóticos. Más específicamente, nuestro trabajo utilizó datos de demostración del robot RT-1 que se recopilaron con 13 robots durante 17 meses en un entorno de cocina de oficina.

RT-2 muestra capacidades de generalización mejoradas y comprensión semántica y visual más allá de los datos robóticos a los que estuvo expuesto. Esto incluye interpretar nuevos comandos y responder a los comandos del usuario realizando un razonamiento rudimentario, como el razonamiento sobre categorías de objetos o descripciones de alto nivel.

También mostramos que la incorporación del razonamiento de cadena de pensamientos le permite a RT-2 realizar un razonamiento semántico de múltiples etapas, como decidir qué objeto podría usarse como un martillo improvisado (una piedra), o qué tipo de bebida es mejor para una persona cansada. (una bebida energética).

Adaptación de VLM para el control robótico

RT-2 se basa en VLM que toman una o más imágenes como entrada y producen una secuencia de tokens que, convencionalmente, representan texto en lenguaje natural. Dichos VLM se han capacitado con éxito en datos a escala web para realizar tareas, como respuestas visuales a preguntas, subtítulos de imágenes o reconocimiento de objetos. En nuestro trabajo, adaptamos el modelo Pathways Language and Image ( PaLI-X ) y Pathways Language model Embodied ( PaLM-E ) para actuar como la columna vertebral de RT-2.

Para controlar un robot, debe estar entrenado para generar acciones. Abordamos este desafío al representar las acciones como tokens en la salida del modelo, similar a los tokens de lenguaje, y describimos las acciones como cadenas que pueden ser procesadas por tokenizadores de lenguaje natural estándar , que se muestran aquí:

La cadena comienza con una bandera que indica si continuar o finalizar el episodio actual, sin ejecutar los comandos posteriores, y sigue con los comandos para cambiar la posición y la rotación del efector final, así como la extensión deseada de la pinza del robot.

Usamos la misma versión discreta de las acciones del robot que en RT-1, y mostramos que convertirlo a una representación de cadena hace posible entrenar modelos VLM en datos robóticos, ya que los espacios de entrada y salida de dichos modelos no necesitan ser cambió.

Generalización y habilidades emergentes

Realizamos una serie de experimentos cualitativos y cuantitativos en nuestros modelos RT-2, en más de 6000 pruebas robóticas. Al explorar las capacidades emergentes de RT-2, primero buscamos tareas que requirieran combinar el conocimiento de los datos a escala web y la experiencia del robot, y luego definimos tres categorías de habilidades: comprensión de símbolos, razonamiento y reconocimiento humano.

Cada tarea requería comprender conceptos semánticos visuales y la capacidad de realizar un control robótico para operar con estos conceptos. Se requieren comandos como “recoge la bolsa que está a punto de caerse de la mesa” o “mueve el plátano a la suma de dos más uno”, donde se le pide al robot que realice una tarea de manipulación en objetos o escenarios nunca vistos en los datos robóticos. conocimiento traducido de datos basados en la web para operar.

En todas las categorías, observamos un mayor rendimiento de generalización (una mejora de más de 3 veces) en comparación con las líneas de base anteriores, como los modelos RT-1 anteriores y modelos como Visual Cortex ( VC-1 ), que fueron entrenados previamente en grandes conjuntos de datos visuales.

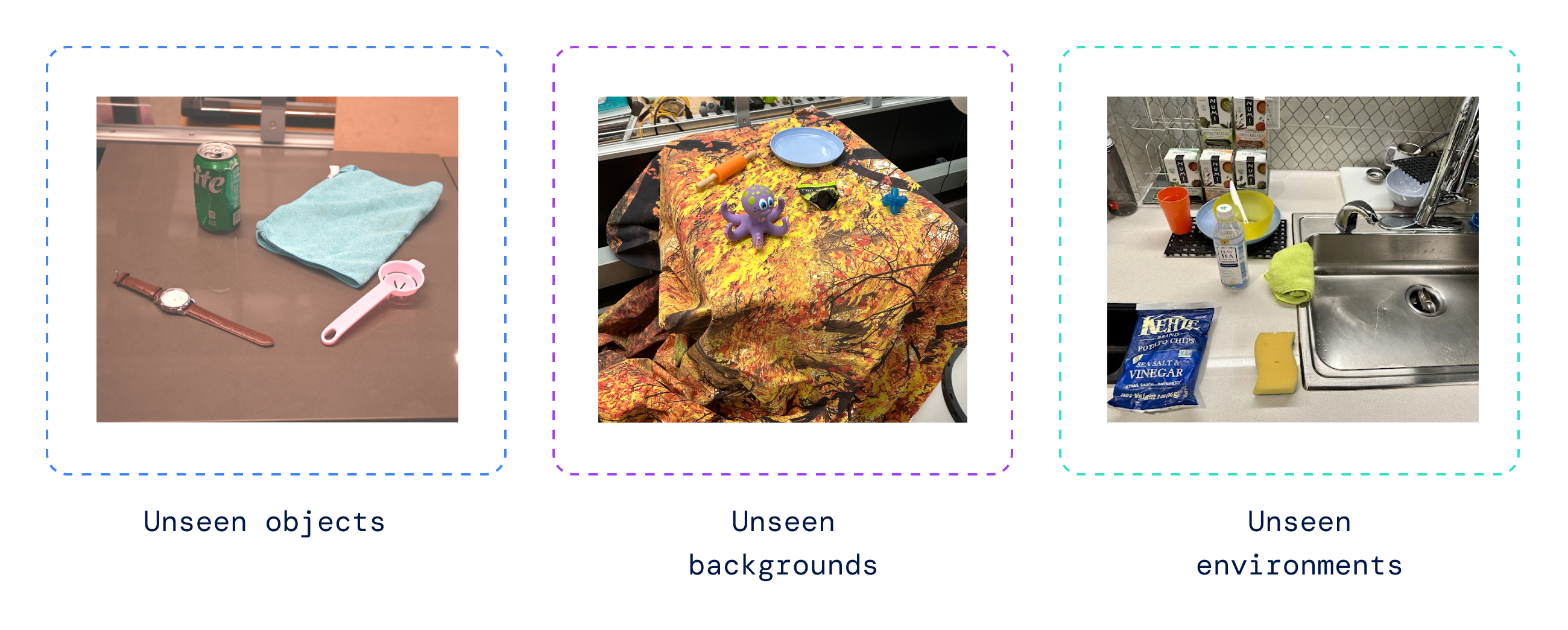

También realizamos una serie de evaluaciones cuantitativas, comenzando con las tareas originales del RT-1, para las cuales tenemos ejemplos en los datos del robot, y continuamos con diversos grados de objetos, fondos y entornos nunca antes vistos por el robot que requerían que el robot aprender la generalización del pre-entrenamiento VLM.

RT-2 mantuvo el rendimiento en las tareas originales vistas en los datos del robot y mejoró el rendimiento en escenarios nunca antes vistos por el robot, del 32 % al 62 % de RT-1, lo que demuestra el considerable beneficio del entrenamiento previo a gran escala.

Además, observamos mejoras significativas sobre las líneas de base entrenadas previamente en tareas solo visuales, como VC-1 y Representaciones reutilizables para manipulación robótica ( R3M ), y algoritmos que usan VLM para la identificación de objetos, como Manipulación de objetos de mundo abierto ( MU ).

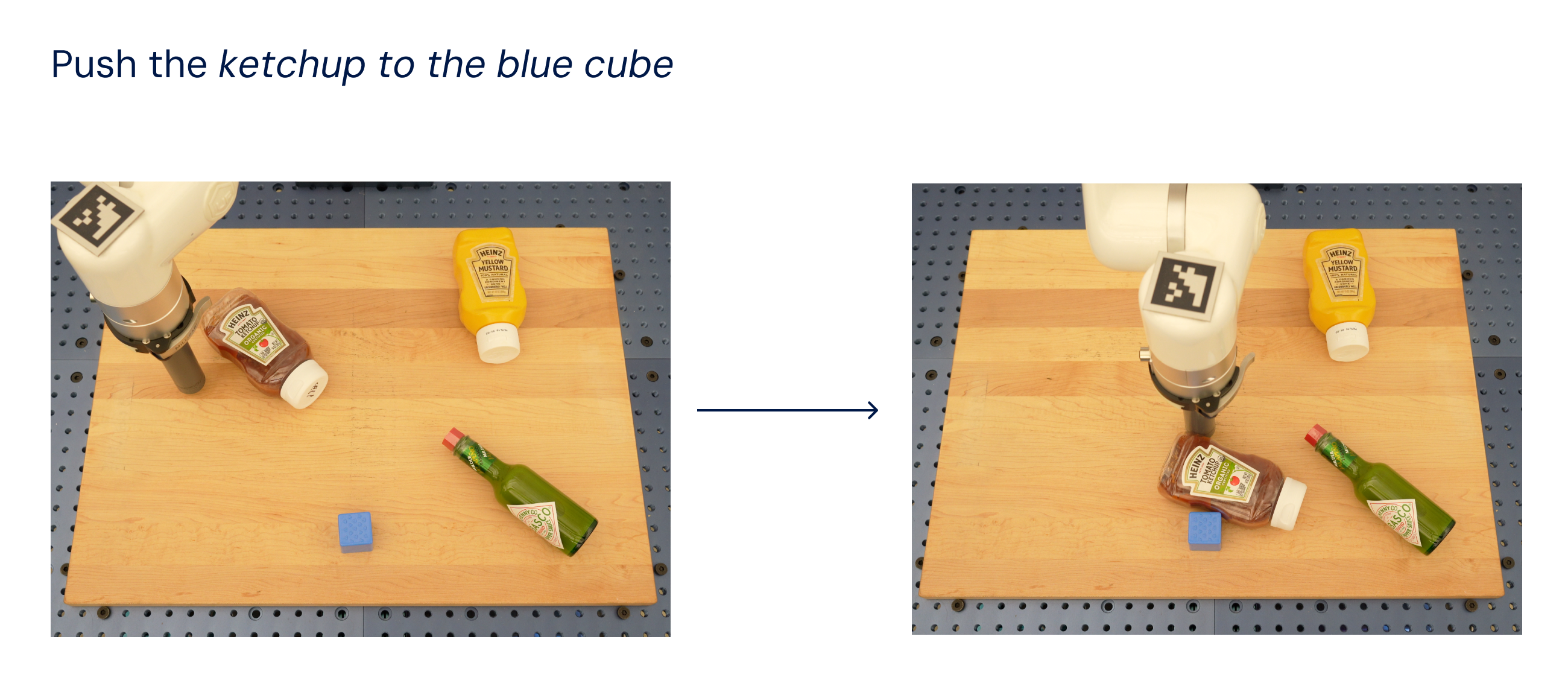

Al evaluar nuestro modelo en el conjunto de tareas robóticas Language Table de código abierto , logramos una tasa de éxito del 90 % en simulación, mejorando sustancialmente con respecto a las líneas de base anteriores, incluidas BC-Z (72 %), RT-1 (74 %) y LAVA (77%).

Luego evaluamos el mismo modelo en el mundo real (ya que fue entrenado en simulación y datos reales) y demostramos su capacidad de generalizar a objetos nuevos, como se muestra a continuación, donde ninguno de los objetos excepto el cubo azul estuvo presente en el entrenamiento. conjunto de datos

Inspirándonos en los métodos de impulso de la cadena de pensamientos utilizados en los LLM , probamos nuestros modelos para combinar el control robótico con el razonamiento de la cadena de pensamientos para permitir el aprendizaje de la planificación a largo plazo y las habilidades de bajo nivel dentro de un solo modelo.

En particular, ajustamos una variante de RT-2 en solo unos pocos cientos de pasos de gradiente para aumentar su capacidad de usar el lenguaje y las acciones de manera conjunta. Luego, aumentamos los datos para incluir un paso adicional de “Plan”, primero describiendo el propósito de la acción que el robot está a punto de realizar en lenguaje natural, seguido de “Acción” y los tokens de acción. Aquí mostramos un ejemplo de dicho razonamiento y el comportamiento resultante del robot:

Con este proceso, RT-2 puede realizar comandos más complicados que requieren un razonamiento sobre los pasos intermedios necesarios para cumplir una instrucción del usuario. Gracias a su red troncal VLM, RT-2 también puede planificar a partir de comandos de imagen y texto, lo que permite una planificación visual, mientras que los enfoques actuales de planificación y acción como SayCan no pueden ver el mundo real y dependen completamente del lenguaje.

Avances en el control robótico

RT-2 muestra que los modelos de visión-lenguaje (VLM) se pueden transformar en poderosos modelos de visión-lenguaje-acción (VLA), que pueden controlar directamente un robot al combinar el entrenamiento previo de VLM con datos robóticos.

Con dos instancias de VLA basadas en PaLM-E y PaLI-X, RT-2 da como resultado políticas robóticas altamente mejoradas y, lo que es más importante, conduce a un rendimiento de generalización y capacidades emergentes significativamente mejores, heredados de pre lenguaje de visión a escala web. -capacitación.

RT-2 no solo es una modificación simple y efectiva sobre los modelos VLM existentes, sino que también muestra la promesa de construir un robot físico de propósito general que pueda razonar, resolver problemas e interpretar información para realizar una amplia gama de tareas en el real. mundo.

Fuente: https://www.deepmind.com/blog/rt-2-new-model-translates-vision-and-language-into-action